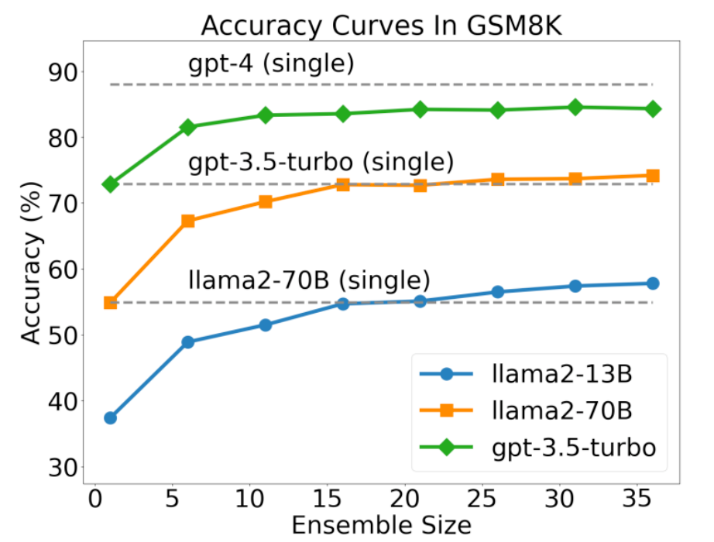

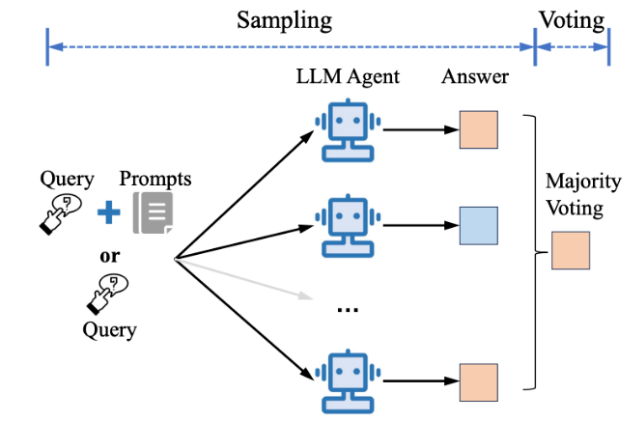

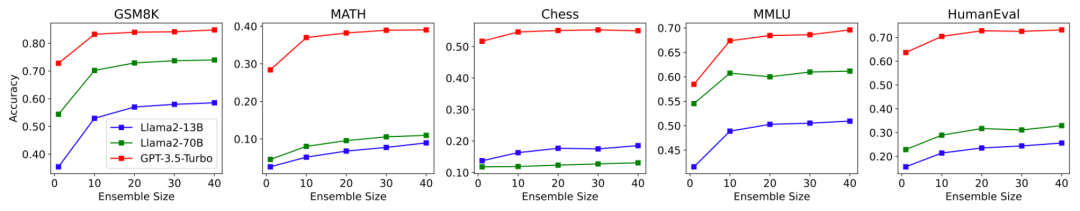

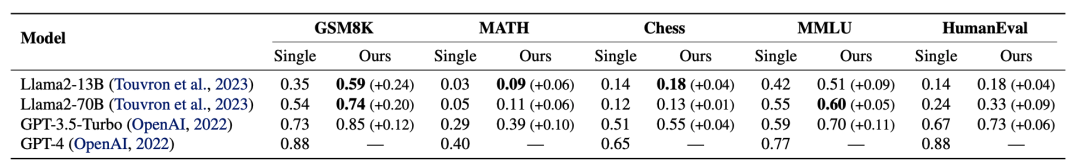

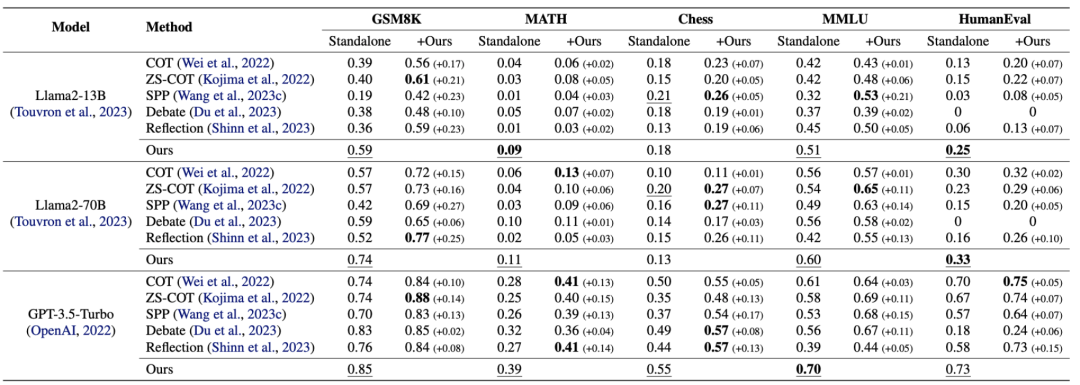

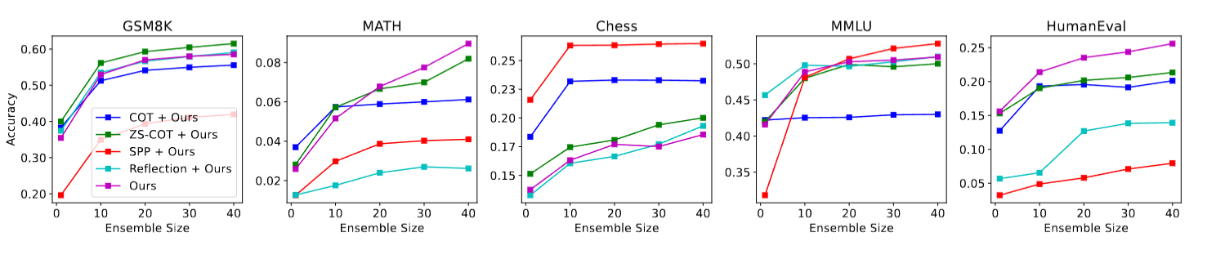

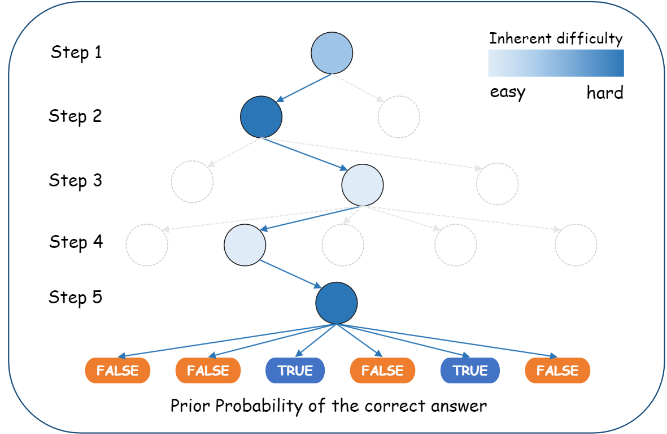

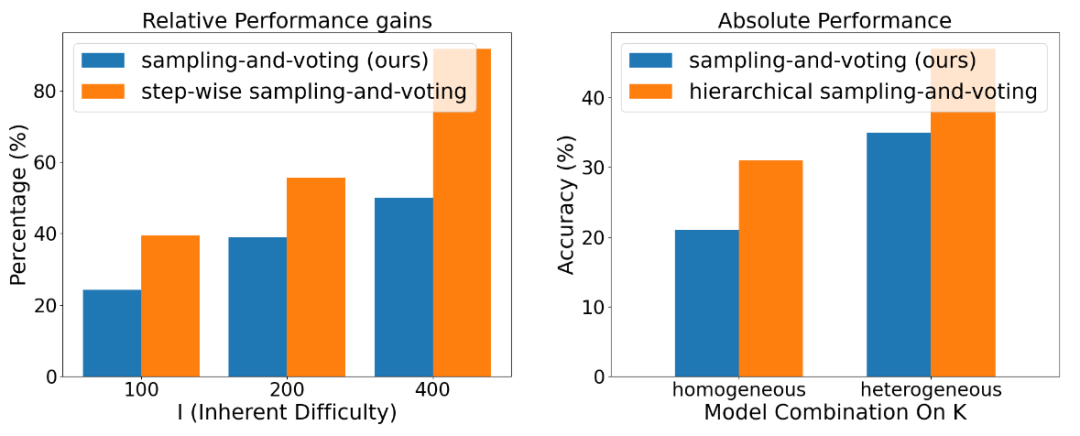

腾讯的研究团队进行了一项关于agent的可拓展性的研究。他们发现,通过简单的采样投票,大型语言模型(llm)的性能随着实例化agent数量的增加而增强。这项研究首次在各种场景中验证了这一现象的普遍性,并与其他复杂方法进行了对比,探讨了这一现象背后的原因,并提出了进一步发挥scaling效应的方法。

☞☞☞AI 智能聊天, 问答助手, AI 智能搜索, 免费无限量使用 DeepSeek R1 模型☜☜☜

论文标题:More Agents Is All You Need

论文地址:https://arxiv.org/abs/2402.05120

代码地址:https://github.com/MoreAgentsIsAllYouNeed/More-Agents-Is-All-You-Need

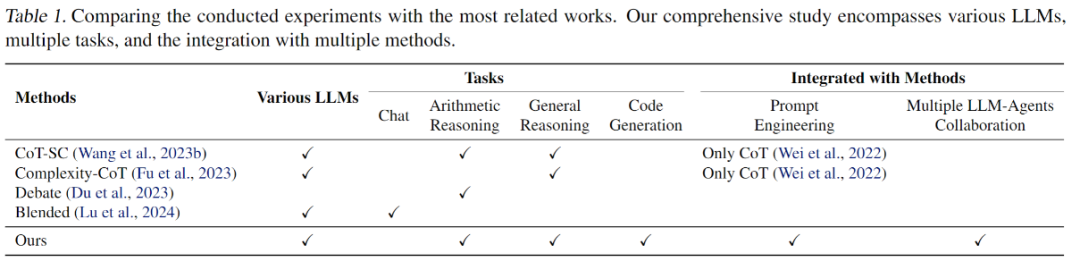

论文详细探讨了多种集成LLM的相关研究,其中包括LLM的自集成、异构LLM的集成,以及多个LLM代理协作框架的研究。通过与提出的方法进行对比,可以看出论文进行了更为全面的研究和分析。

Waymark

Waymark

Waymark是一个视频制作工具,帮助企业快速轻松地制作高影响力的广告。

79 查看详情

79 查看详情

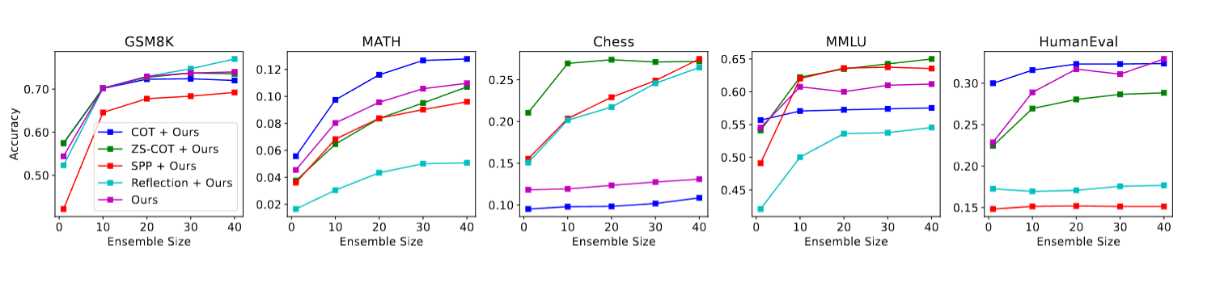

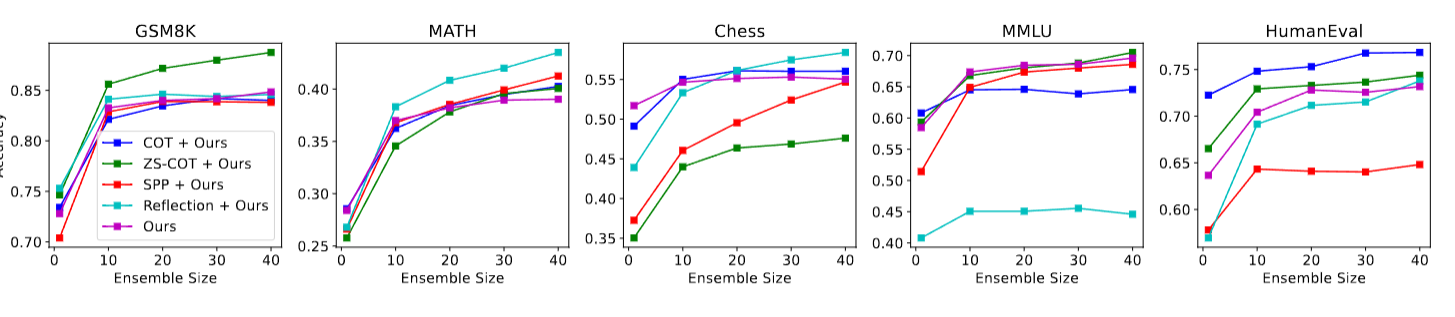

基于 LLama13B

基于 LLama70B

基于 GPT-3.5-Turbo

以上就是数量即力量!腾讯揭秘:Agent数量越多,大语言模型效果越好的详细内容,更多请关注创想鸟其它相关文章!

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。

如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 chuangxiangniao@163.com 举报,一经查实,本站将立刻删除。

发布者:程序猿,转转请注明出处:https://www.chuangxiangniao.com/p/1005146.html

微信扫一扫

微信扫一扫  支付宝扫一扫

支付宝扫一扫