OpenBMB 正式发布并开源 MiniCPM4.1-8B,这是业界首个开源的混合推理大语言模型。该模型通过多项系统性创新,实现了在端侧设备上的极致高效运行,并支持深度推理与常规模式之间的一键自由切换。

该模型在 8B 参数量级下,从模型架构、训练数据、训练算法到推理系统四大层面进行深度优化,全面提升了端侧部署的可行性与性能表现。

核心优势

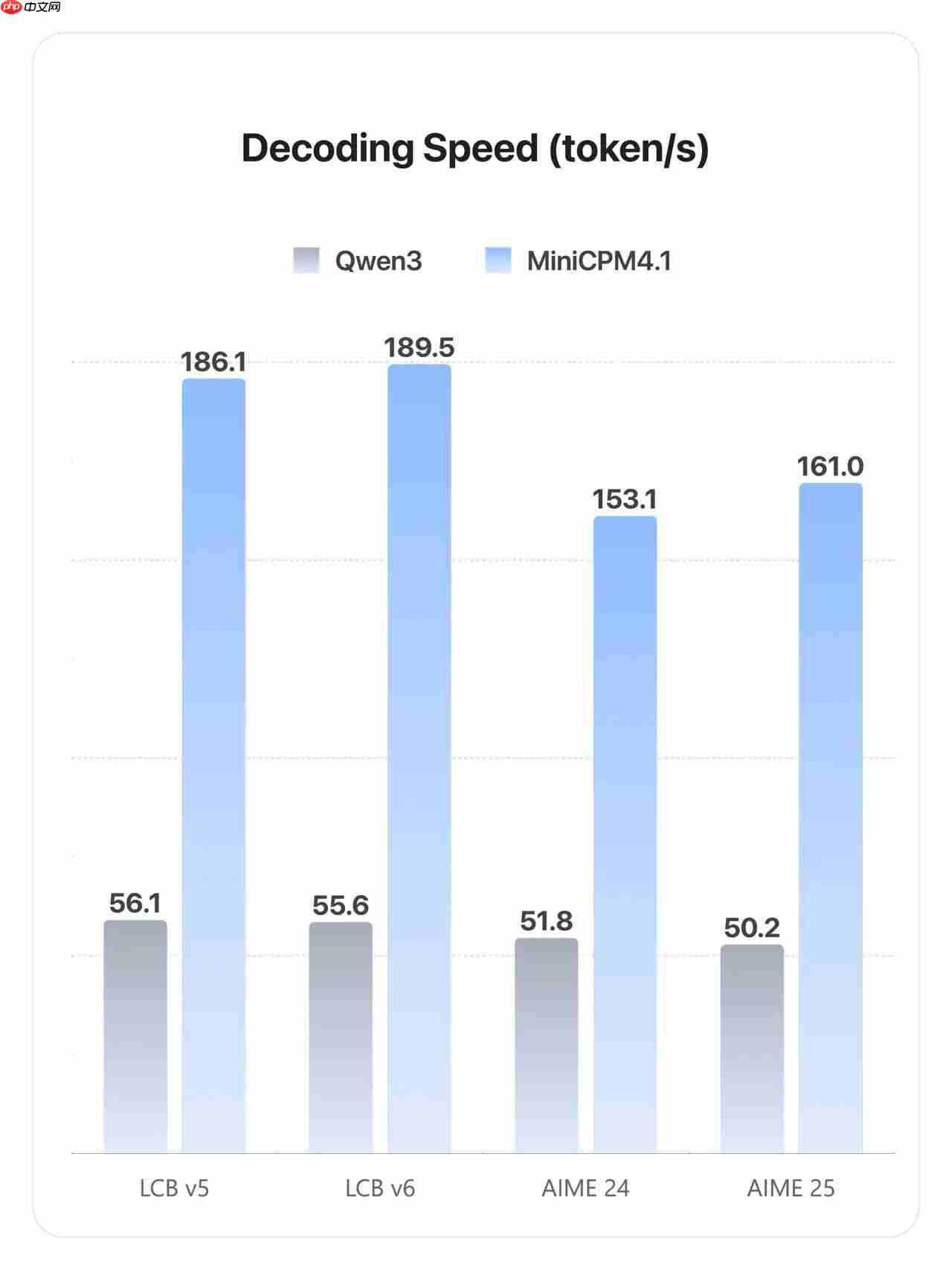

全球首个原生稀疏架构的深度推理模型,引入可训练的稀疏注意力机制 InfLLM v2,在代码生成、数学推导等复杂任务中,推理速度较同规模开源模型提升超 3 倍在涵盖知识理解、逻辑推理、编程能力、指令执行等 15 项评测基准中,综合得分位居 8B 级别模型首位创新性支持“双频换挡”机制:处理长文本时启用稀疏模式,短文本则切换至稠密模式,兼顾效率与精度极致端侧适配,在 128K 超长上下文场景下,所需缓存空间仅为 Qwen3-8B 的 25%,大幅降低硬件资源消耗

OpenBMB

OpenBMB

OpenBMB 让大模型飞入千家万户

151 查看详情

151 查看详情

MiniCPM4.1-8B 搭载升级版 InfLLM v2 稀疏注意力技术,在处理 128K 长文本时,每个 token 仅需与不足 5% 的历史 token 进行注意力计算,显著减少计算冗余。原生支持 65,536 token 上下文长度,并可通过 LongRoPE 技术扩展至 131,072 token,满足复杂长文本处理需求。

目前,MiniCPM4.1-8B 已全面开源,代码与模型权重已上线 GitHub、Hugging Face 及魔搭社区,供研究与应用使用。

?GitHub:https://www.php.cn/link/10164f723a34e25cd518da38b02af653

?Hugging Face:https://www.php.cn/link/3ffa944140b77ef7b5e7500eb4ca2fe5

?ModelScope:https://www.php.cn/link/95b428e98d2b66a8ab324313cfc45300

源码下载地址:点击获取

以上就是OpenBMB 发布并开源 MiniCPM 4.1-8B的详细内容,更多请关注创想鸟其它相关文章!

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。

如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 chuangxiangniao@163.com 举报,一经查实,本站将立刻删除。

发布者:程序猿,转转请注明出处:https://www.chuangxiangniao.com/p/242818.html

微信扫一扫

微信扫一扫  支付宝扫一扫

支付宝扫一扫