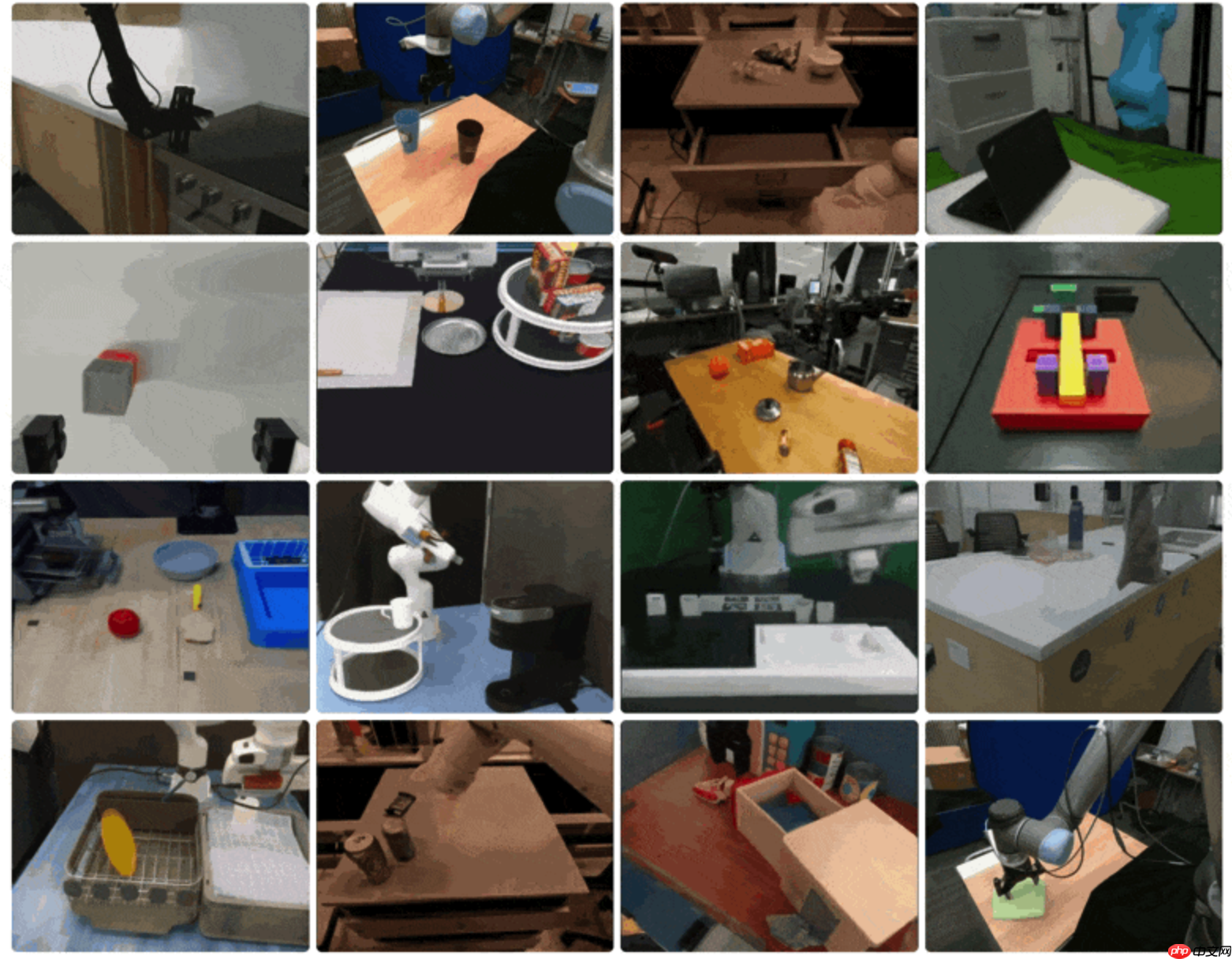

宇树科技近日发布了面向多种机器人本体的开源世界模型-动作(wma)架构——unifolm-wma-0。该架构致力于为通用机器人学习构建统一的技术底座,其核心是一个能够理解机器人与环境之间物理交互规律的世界模型。

这一世界模型具备两大关键能力:

仿真引擎:可作为交互式仿真工具,用于生成机器人学习所需的合成数据。策略增强:能与动作头模块无缝对接,通过预测未来与物理环境的交互过程,提升决策质量。

模型可接收视觉图像和自然语言指令,并据此生成符合语义描述的未来动作视频序列。

N世界

N世界

一分钟搭建会展元宇宙

36 查看详情

36 查看详情

据官方说明,UnifoLM-WMA-0 支持两种工作模式:

决策模式:输出机器人与环境物理交互的预测结果,辅助策略网络生成更优动作。仿真模式:根据给定的机器人动作,生成高保真的环境响应反馈。

在训练过程中,研发团队利用宇树科技公开发布的5个开源数据集对模型进行训练。测试表明,该模型能够基于“当前画面”以及预设的“未来机器人动作”,实现可控的交互内容生成,并展现出在长周期任务中持续生成合理交互行为的能力。

项目主页:https://www.php.cn/link/a7a1b53e91a3344e9eb9db2a6fa4eae2

开源代码地址:https://www.php.cn/link/5cd338743288fdb62b74ee279d51bf93

以上就是宇树科技发布开源世界模型-动作架构:UnifoLM-WMA-0的详细内容,更多请关注创想鸟其它相关文章!

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。

如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 chuangxiangniao@163.com 举报,一经查实,本站将立刻删除。

发布者:程序猿,转转请注明出处:https://www.chuangxiangniao.com/p/349214.html

微信扫一扫

微信扫一扫  支付宝扫一扫

支付宝扫一扫