☞☞☞AI 智能聊天, 问答助手, AI 智能搜索, 免费无限量使用 DeepSeek R1 模型☜☜☜

双向LSTM模型是一种用于文本分类的神经网络。以下是一个简单示例,演示如何使用双向LSTM进行文本分类任务。

首先,我们需要导入所需的库和模块:

import os import numpy as np from keras.preprocessing.text import Tokenizer from keras.preprocessing.sequence import pad_sequences from keras.models import Sequential from keras.layers import Dense, Embedding, Bidirectional, LSTM from sklearn.model_selection import train_test_split

接下来,我们需要准备数据集。这里我们假设数据集已经存在于指定的路径中,包含三个文件:train.txt、dev.txt和test.txt。每个文件中包含一系列文本和对应的标签。我们可以使用以下代码加载数据集:

def load_imdb_data(path): assert os.path.exists(path) trainset, devset, testset = [], [], [] with open(os.path.join(path, "train.txt"), "r") as fr: for line in fr: sentence_label, sentence = line.strip().lower().split("t", maxsplit=1) trainset.append((sentence, sentence_label)) with open(os.path.join(path, "dev.txt"), "r") as fr: for line in fr: sentence_label, sentence = line.strip().lower().split("t", maxsplit=1) devset.append((sentence, sentence_label)) with open(os.path.join(path, "test.txt"), "r") as fr: for line in fr: sentence_label, sentence = line.strip().lower().split("t", maxsplit=1) testset.append((sentence, sentence_label)) return trainset, devset, testset

加载数据集后,我们可以对文本进行预处理和序列化。这里我们使用Tokenizer进行文本分词,然后将每个词的索引序列填充到相同的长度,以便能够应用于LSTM模型。

文心大模型

文心大模型

百度飞桨-文心大模型 ERNIE 3.0 文本理解与创作

56 查看详情

56 查看详情

max_features = 20000 maxlen = 80 # cut texts after this number of words (among top max_features most common words) batch_size = 32 print('Pad & split data into training set and dev set') x_train, y_train = [], [] for sent, label in trainset: x_train.append(sent) y_train.append(label) x_train, y_train = pad_sequences(x_train, maxlen=maxlen), np.array(y_train) x_train, y_train = np.array(x_train), np.array(y_train) x_dev, y_dev = [], [] for sent, label in devset: x_dev.append(sent) y_dev.append(label) x_dev, y_dev = pad_sequences(x_dev, maxlen=maxlen), np.array(y_dev) x_dev, y_dev = np.array(x_dev), np.array(y_dev)

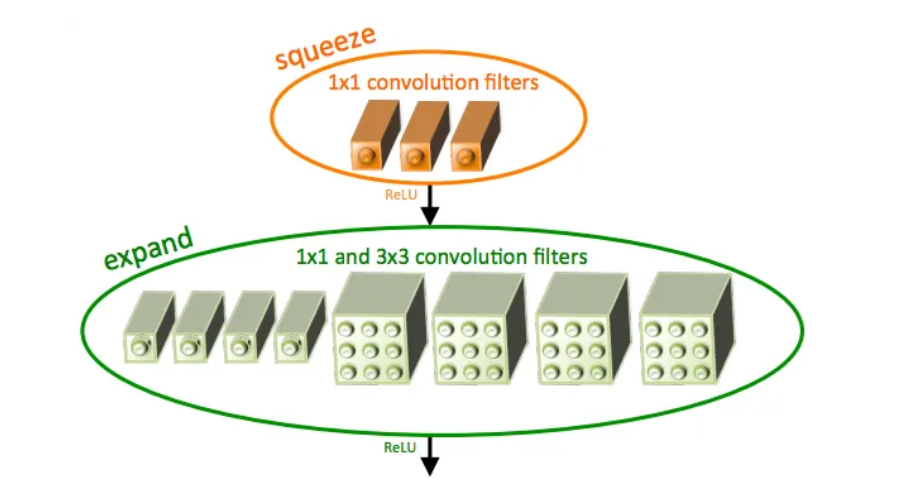

接下来,我们可以构建双向LSTM模型。在这个模型中,我们使用两个LSTM层,一个正向传递信息,一个反向传递信息。这两个LSTM层的输出被连接起来,形成一个更强大的表示文本的向量。最后,我们使用全连接层进行分类。

print('Build model...') model = Sequential() model.add(Embedding(max_features, 128, input_length=maxlen)) model.add(Bidirectional(LSTM(64))) model.add(LSTM(64)) model.add(Dense(1, activation='sigmoid')) print('Compile model...') model.compile(loss='binary_crossentropy', optimizer='adam', metrics=['accuracy'])

现在,我们可以训练模型了。我们将使用dev数据集作为验证数据,以确保我们在训练过程中不会过度拟合。

epochs = 10 batch_size = 64 history = model.fit(x_train, y_train, batch_size=batch_size, epochs=epochs, validation_data=(x_dev, y_dev))

训练完成后,我们可以评估模型在测试集上的表现。

test_loss, test_acc = model.evaluate(x_test, y_test) print('Test accuracy:', test_acc)

以上,是一个简单的双向LSTM模型的文本分类示例。您还可以尝试调整模型的参数,如层数、神经元数量、优化器等,以获得更好的性能。亦或是使用预训练的词嵌入(例如Word2Vec或GloVe)来替换嵌入层,以捕获更多的语义信息。

以上就是利用双向LSTM模型进行文本分类的案例的详细内容,更多请关注创想鸟其它相关文章!

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。

如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 chuangxiangniao@163.com 举报,一经查实,本站将立刻删除。

发布者:程序猿,转转请注明出处:https://www.chuangxiangniao.com/p/431452.html

微信扫一扫

微信扫一扫  支付宝扫一扫

支付宝扫一扫