联邦学习使用多个参与方可以在数据隐私得到保护的情况下训练模型。但是由于服务器无法监控参与者在本地进行的训练过程,参与者可以篡改本地训练模型,从而对联邦学习的整体模型构成安全隐患,如后门攻击。

本文重点关注如何在有防御保护的训练框架下,对联邦学习发起后门攻击。本文发现后门攻击的植入与部分神经网络层的相关性更高,并将这些层称为后门攻击关键层。在联邦学习中,参与训练的客户端分布在不同的设备上,它们各自训练自己的模型,然后将更新的模型参数上传至服务器进行聚合。由于参与训练的客户端不可信,存在一定风险,因此服务器

基于后门关键层的发现,本文提出通过攻击后门关键层绕过防御算法检测,从而可以控制少量的参与者进行高效的后门攻击。

☞☞☞AI 智能聊天, 问答助手, AI 智能搜索, 免费无限量使用 DeepSeek R1 模型☜☜☜

论文题目:Backdoor Federated Learning By Poisoning Backdoor-Critical Layers

论文链接:https://openreview.net/pdf?id=AJBGSVSTT2

代码链接:https://github.com/zhmzm/Poisoning_Backdoor-critical_Layers_Attack

方法

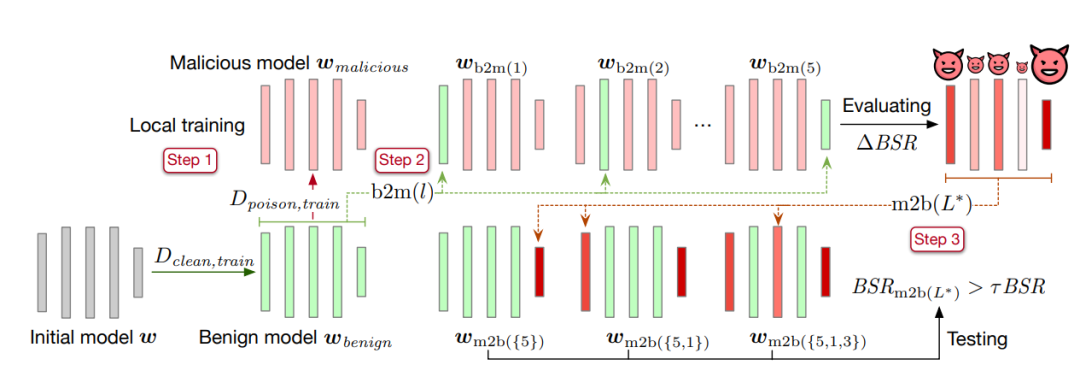

本文提出层替换方法识别后门关键层。具体方法如下:

第一步,先将模型在干净数据集上训练至收敛,并保存模型参数记为良性模型 。再将良性模型的复制在含有后门的数据集上训练,收敛后保存模型参数并记为恶意模型

。再将良性模型的复制在含有后门的数据集上训练,收敛后保存模型参数并记为恶意模型 。

。

第二步,取良性模型中一层参数替换到包含后门的恶意模型中,并计算所得到的模型的后门攻击成功率 。将得到的后门攻击成功率与恶意模型的后门攻击成功率 BSR 做差得到 △BSR,可得到该层对后门攻击的影响程度。对神经网络中每一层使用相同的方法,可得到一个记录所有层对后门攻击影响程度的列表。

。将得到的后门攻击成功率与恶意模型的后门攻击成功率 BSR 做差得到 △BSR,可得到该层对后门攻击的影响程度。对神经网络中每一层使用相同的方法,可得到一个记录所有层对后门攻击影响程度的列表。

第三步,对所有层按照对后门攻击的影响程度进行排序。将列表中影响程度最大的一层取出并加入后门攻击关键层集合  ,并将恶意模型中的后门攻击关键层(在集合

,并将恶意模型中的后门攻击关键层(在集合  中的层)参数植入良性模型。计算所得到模型的后门攻击成功率

中的层)参数植入良性模型。计算所得到模型的后门攻击成功率 。如果后门攻击成功率大于所设阈值 τ 乘以恶意模型后门攻击成功率

。如果后门攻击成功率大于所设阈值 τ 乘以恶意模型后门攻击成功率 ,则停止算法。若不满足,则继续将列表所剩层中最大的一层加入后门攻击关键层

,则停止算法。若不满足,则继续将列表所剩层中最大的一层加入后门攻击关键层 直到满足条件。

直到满足条件。

在得到后门攻击关键层的集合之后,本文提出通过攻击后门关键层的方法来绕过防御方法的检测。除此之外,本文引入模拟聚合和良性模型中心进一步减小与其他良性模型的距离。

实验结果

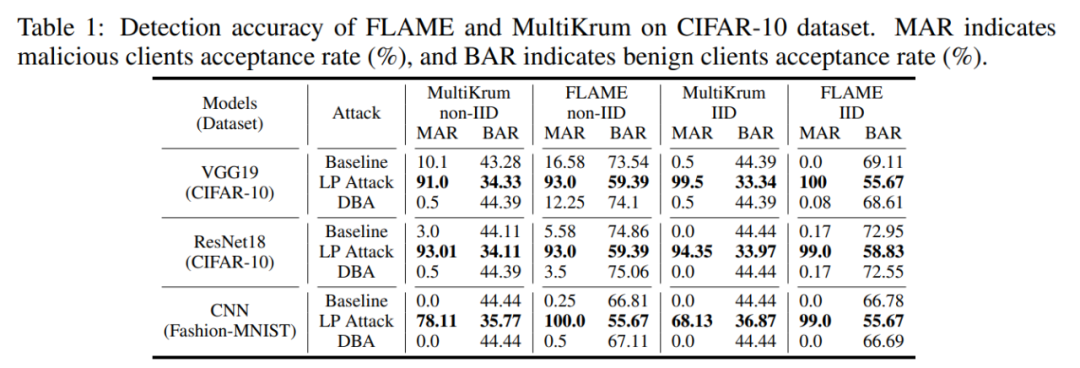

本文对多个防御方法在 CIFAR-10 和 MNIST 数据集上验证了基于后门关键层攻击的有效性。实验将分别使用后门攻击成功率 BSR 和恶意模型接收率 MAR(良性模型接收率 BAR)作为衡量攻击有效性的指标。

可图大模型

可图大模型

可图大模型(Kolors)是快手大模型团队自研打造的文生图AI大模型

32 查看详情

32 查看详情

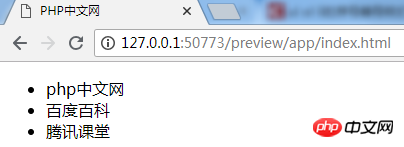

首先,基于层的攻击 LP Attack 可以让恶意客户端获得很高的选取率。如下表所示,LP Attack 在 CIFAR-10 数据集上得到了 90% 的接收率,远高于良性用户的 34%。

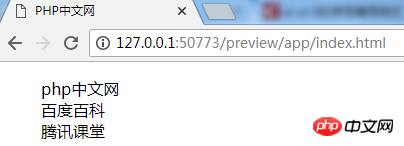

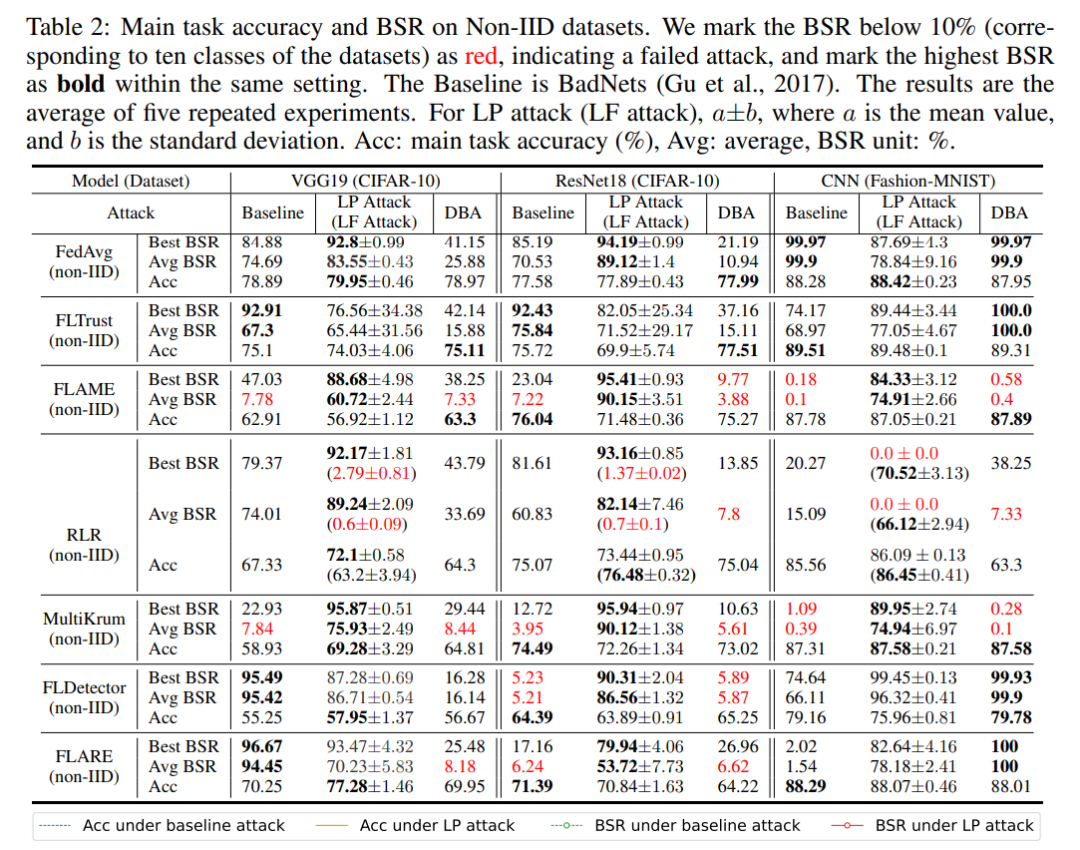

然后,LP Attack 可以取得很高的后门攻击成功率,即使在只有 10% 恶意客户端的设定下。如下表所示,LP Attack 在不同的数据集和不同的防御方法保护下,均能取得很高的后门攻击成功率 BSR。

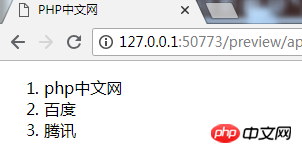

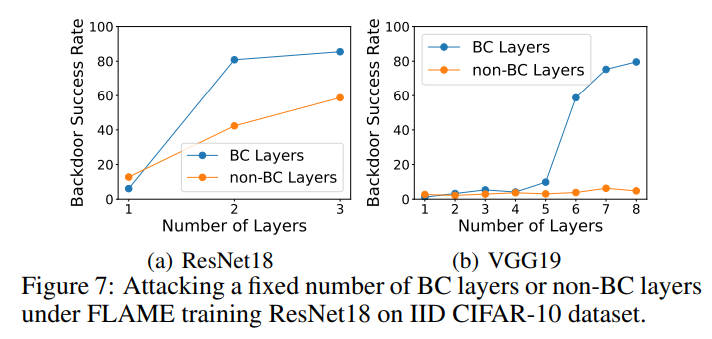

在消融实验中,本文分别对后门关键层和非后门关键层进行投毒并测量两种实验的后门攻击成功率。如下图所示,攻击相同层数的情况下,对非后门关键层进行投毒的成功率远低于对后门关键层进行投毒,这表明本文的算法可以选择出有效的后门攻击关键层。

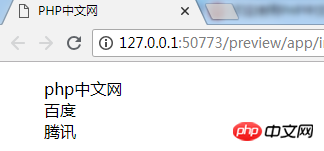

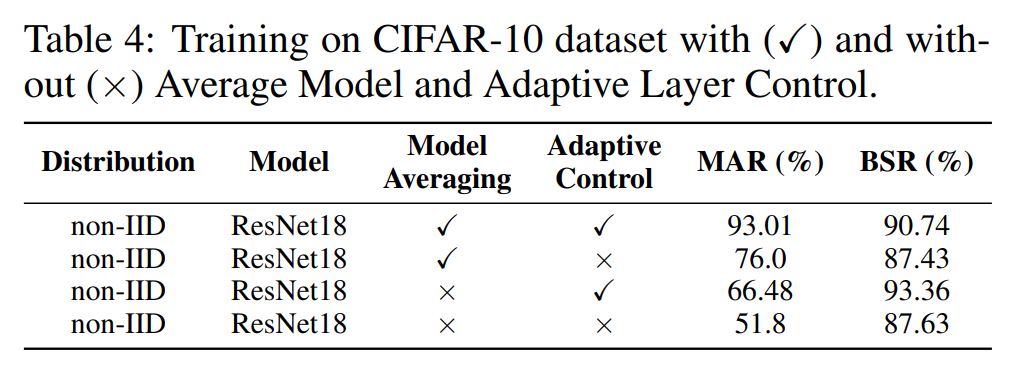

除此之外,我们对模型聚合模块 Model Averaging 和自适应控制模块 Adaptive Control 进行消融实验。如下表所示,这两个模块均对提升选取率和后门攻击成功率,证明了这两个模块的有效性。

总结

本文发现后门攻击与部分层紧密相关,并提出了一种算法搜寻后门攻击关键层。本文利用后门攻击关键层提出了针对联邦学习中保护算法的基于层的 layer-wise 攻击。所提出的攻击揭示了目前三类防御方法的漏洞,表明未来将需要更加精细的防御算法对联邦学习安全进行保护。

作者介绍

Zhuang Haomin,本科毕业于华南理工大学,曾于路易斯安那州立大学 IntelliSys 实验室担任研究助理,现于圣母大学就读博士。主要研究方向为后门攻击和对抗样本攻击。

以上就是ICLR 2024 | 联邦学习后门攻击的模型关键层的详细内容,更多请关注创想鸟其它相关文章!

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。

如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 chuangxiangniao@163.com 举报,一经查实,本站将立刻删除。

发布者:程序猿,转转请注明出处:https://www.chuangxiangniao.com/p/617685.html

微信扫一扫

微信扫一扫  支付宝扫一扫

支付宝扫一扫