jamba

-

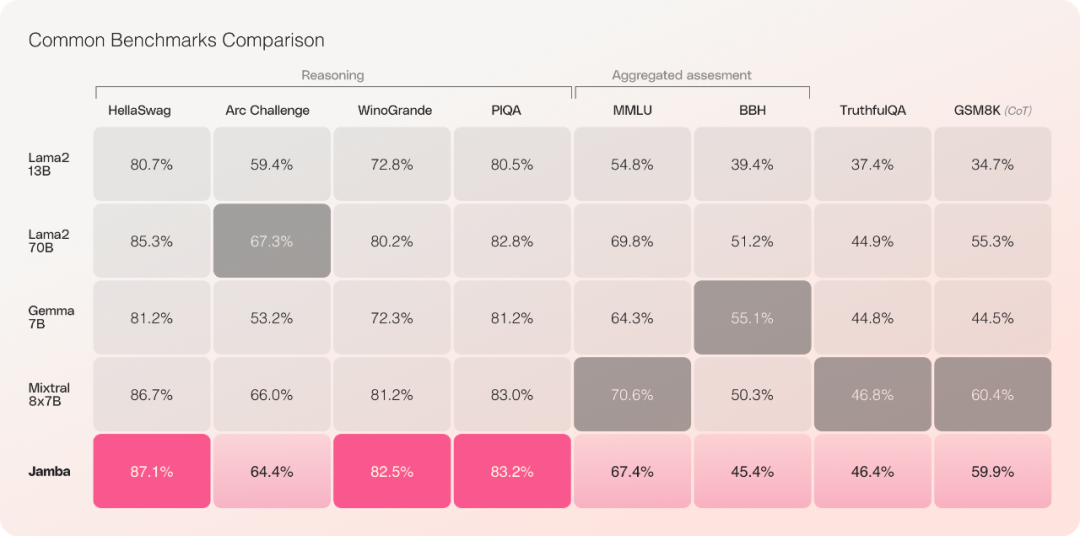

Attention isn’t all you need!Mamba混合大模型开源:三倍Transformer吞吐量

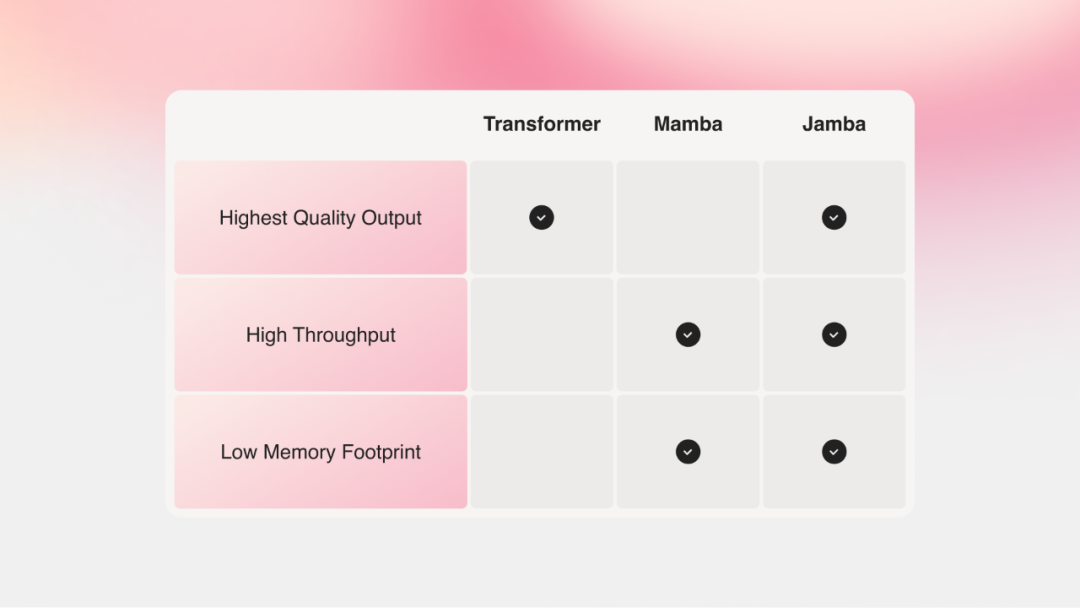

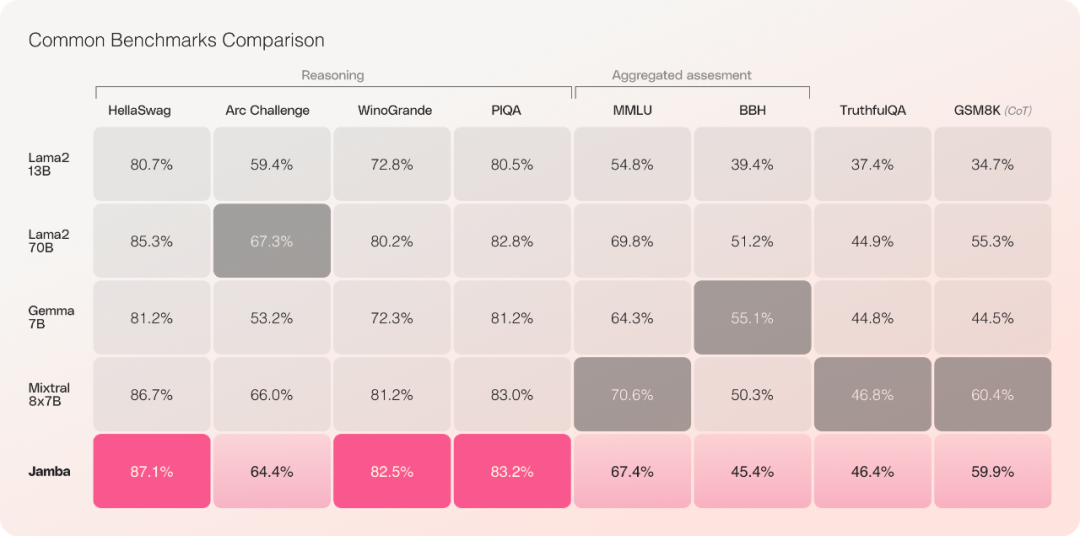

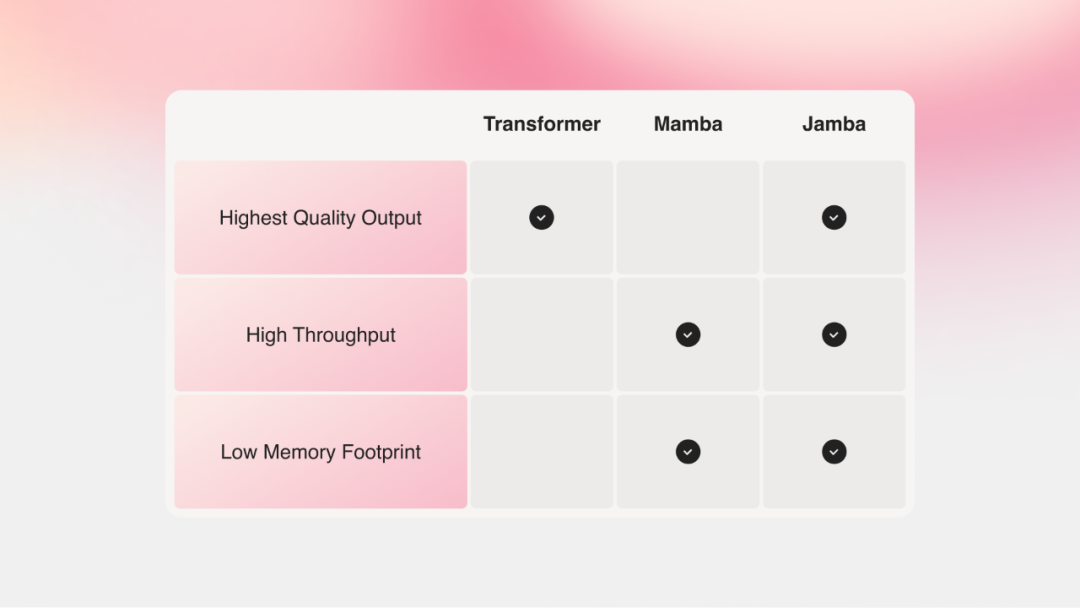

mamba 时代来了? 自 2017 年开创性研究论文《Attention is All You Need》问世以来,transformer 架构就一直主导着生成式人工智能领域。 然而,transformer 架构实际上有两个显著缺点: Transformer 的内存占用量随上下文长短而变化。这使得…

mamba 时代来了? 自 2017 年开创性研究论文《Attention is All You Need》问世以来,transformer 架构就一直主导着生成式人工智能领域。 然而,transformer 架构实际上有两个显著缺点: Transformer 的内存占用量随上下文长短而变化。这使得…