stargen

-

生成越长越跑偏?浙大商汤新作StarGen让场景视频生成告别「短片魔咒」

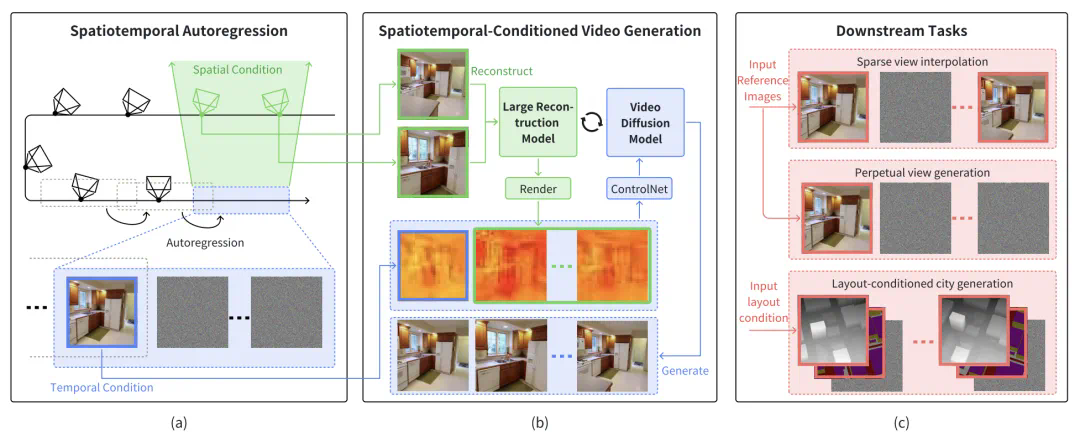

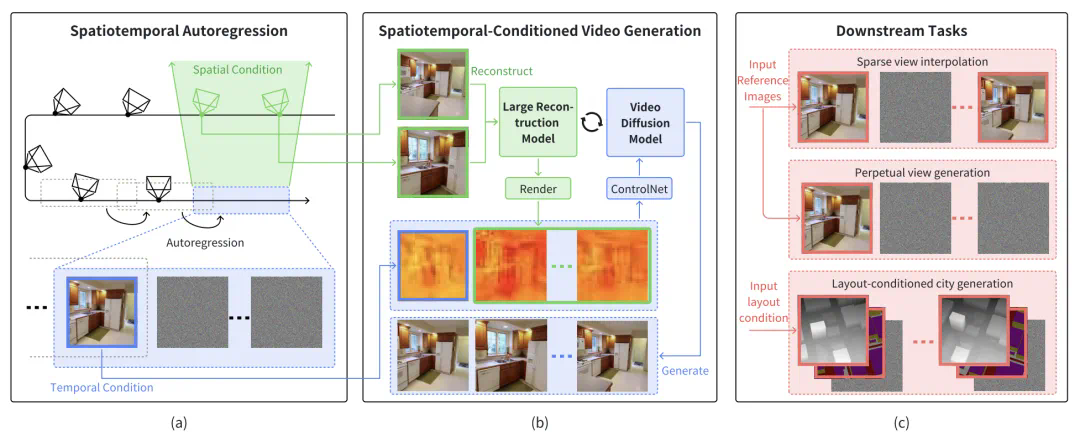

浙江大学和商汤科技的研究人员提出了一种名为stargen的新型时空自回归框架,用于实现可扩展且可控的场景生成。该框架巧妙地结合了空间和时间双重条件机制,将稀疏视图的3d几何信息与视频扩散模型有效融合,从而解决了复杂场景长距离生成中时空一致性难题,显著降低了误差累积。 ☞☞☞AI 智能聊天, 问答助手…

浙江大学和商汤科技的研究人员提出了一种名为stargen的新型时空自回归框架,用于实现可扩展且可控的场景生成。该框架巧妙地结合了空间和时间双重条件机制,将稀疏视图的3d几何信息与视频扩散模型有效融合,从而解决了复杂场景长距离生成中时空一致性难题,显著降低了误差累积。 ☞☞☞AI 智能聊天, 问答助手…