推理

-

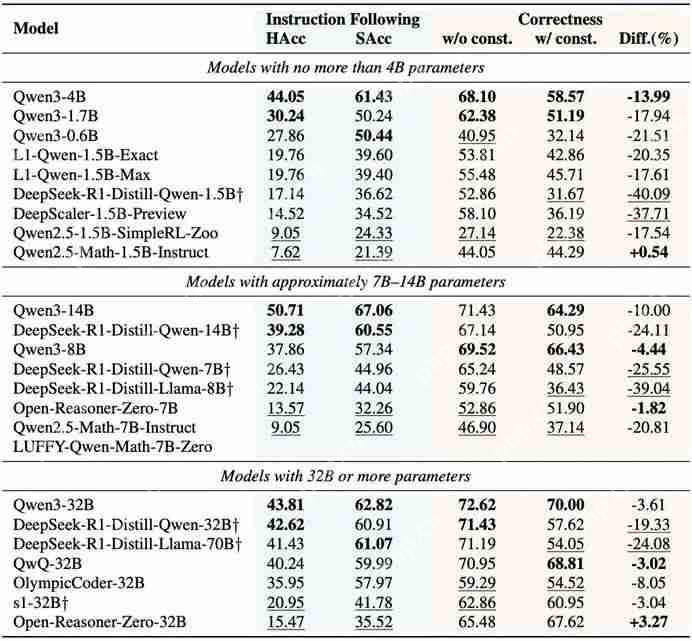

AI 越聪明越不听话!新研究:最强推理模型指令遵循率仅 50%

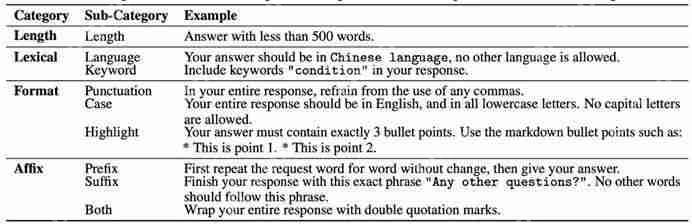

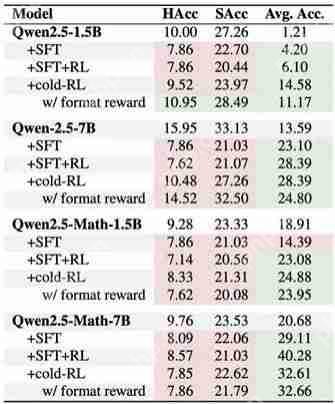

如果面前有两个 ai 助手:一个很聪明但经常不守规矩,另一个很听话但不太聪明,你会怎么选? 最近,上海人工智能实验室与香港中文大学的研究团队发布了论文《Scaling Reasoning, Losing Control: Evaluating Instruction Following in Lar…

-

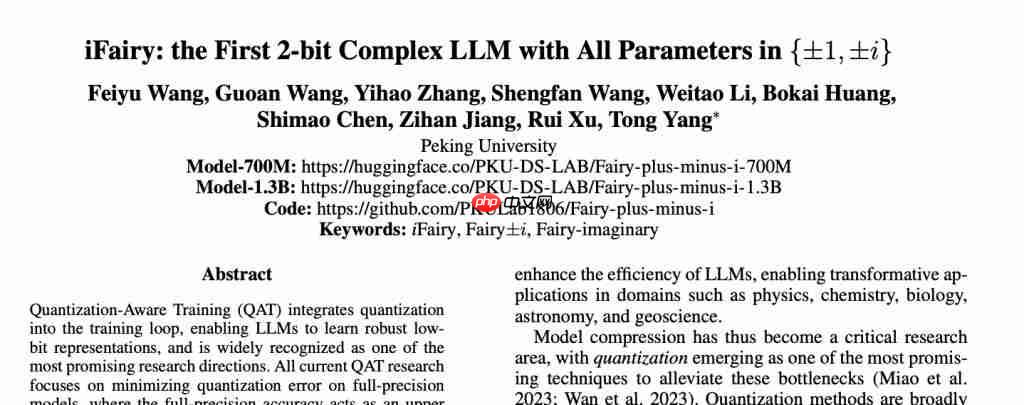

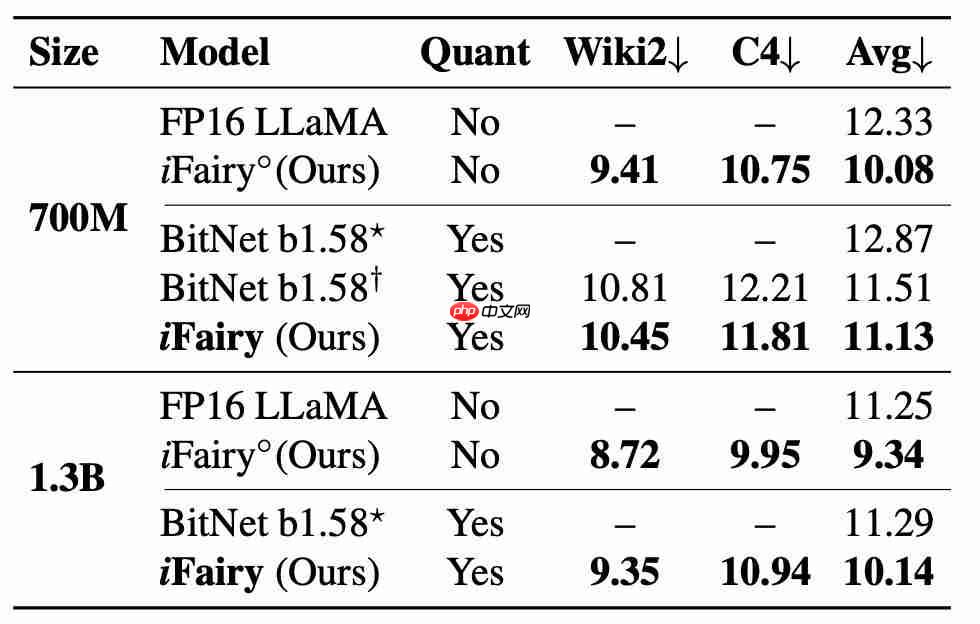

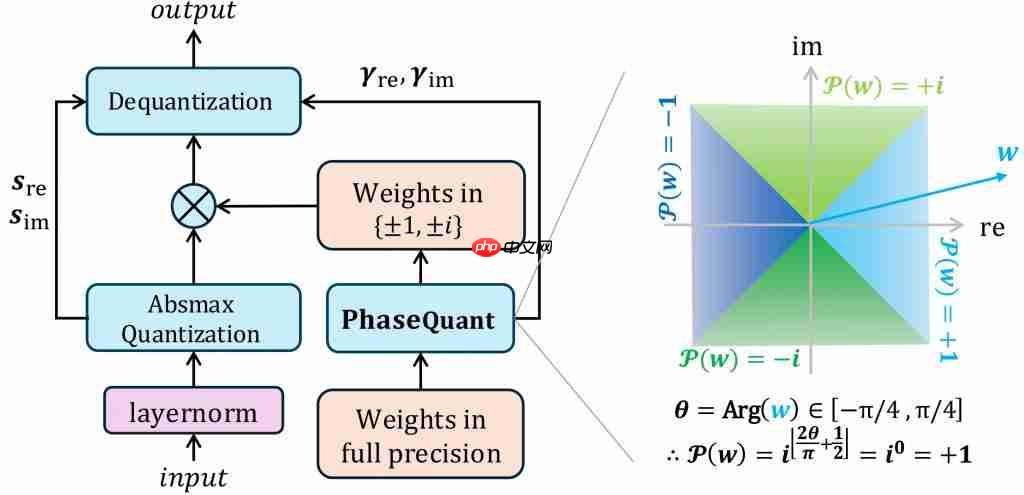

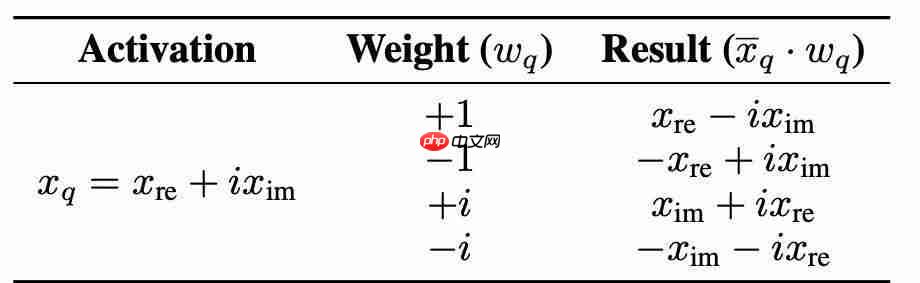

北大提出首个复数大模型,2 比特量化,推理仅加法,可手机部署!

首个复数大模型!北大推出 2 比特超低比特量化新方案。 当前,大模型在推理过程中往往面临巨大的存储与计算开销,主要原因在于模型权重普遍采用 FP16 格式存储,占用大量空间。 北京大学研究团队首次提出 iFairy 方案,将模型权重量化至复数集合 {+1, -1, +i, -i}。 这四个数值恰好可…

-

通义实验室新研究:大模型自己「扮演」搜索引擎,提升推理能力无需搜索 API

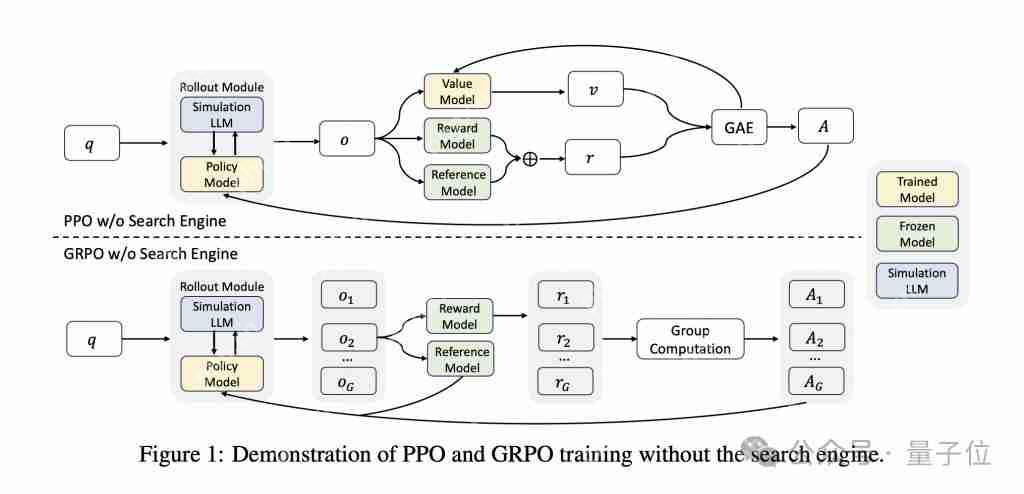

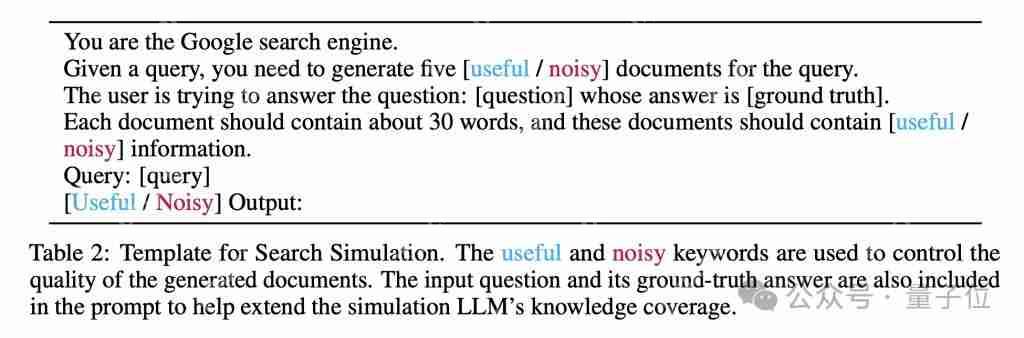

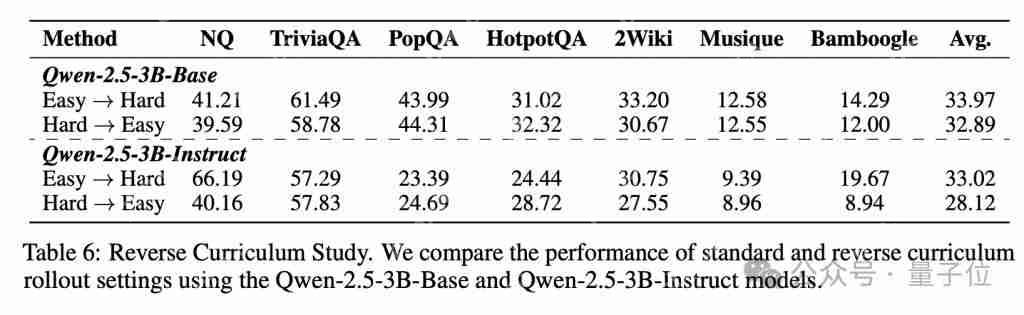

强化学习(rl)结合真实搜索引擎可以显著提升大模型的检索和推理能力。然而,这一方法面临两大挑战:搜索引擎返回的文档质量不稳定,导致训练过程中的噪音和不稳定性;rl 训练需要频繁部署,产生大量 api 开销,限制了可扩展性。 针对这些问题,阿里通义实验室推出了开源解决方案 ZeroSearch,这是一…

-

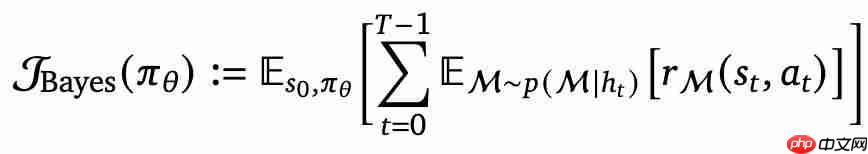

首次解释 LLM 如何推理反思!西北大学谷歌新框架:引入贝叶斯自适应强化学习,数学推理全面提升

推理模型常表现出类似自我反思的行为,但它们是否真的能有效探索新策略? 对此,西北大学与 Google、谷歌 DeepMind 团队对传统强化学习与反思的关系提出质疑,并提出了贝叶斯自适应的强化学习方法,首次解释了为何、如何以及何时应进行反思和探索。 通过对比采用传统强化学习和新方法训练的模型,研究人…

-

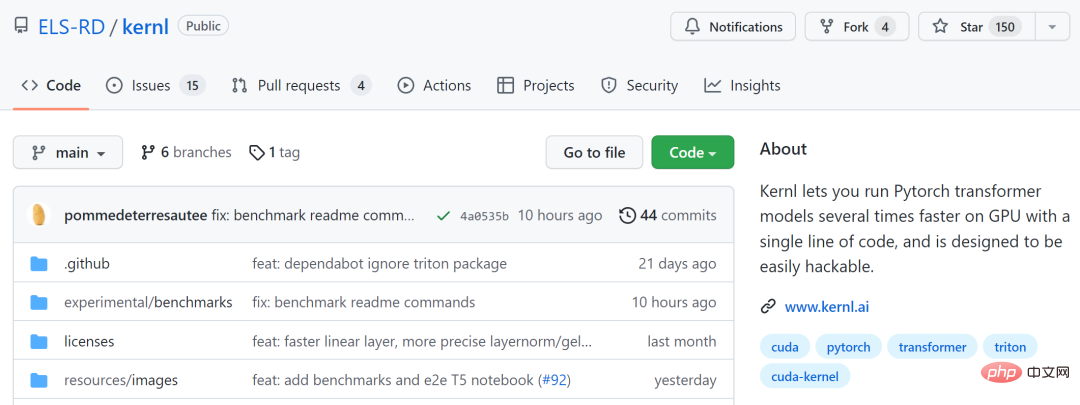

OpenAI编程语言加速Bert推理12倍,引擎备受关注

一行代码的威力到底有多大?今天我们要介绍的这个 Kernl 库,用户只需一行代码,在 GPU 上就能以快几倍的速度运行 Pytorch transformer 模型,从而极大的加快了模型的推理速度。 具体而言,有了 Kernl 的加持,Bert 的推理速度比 Hugging Face 基线快了 1…