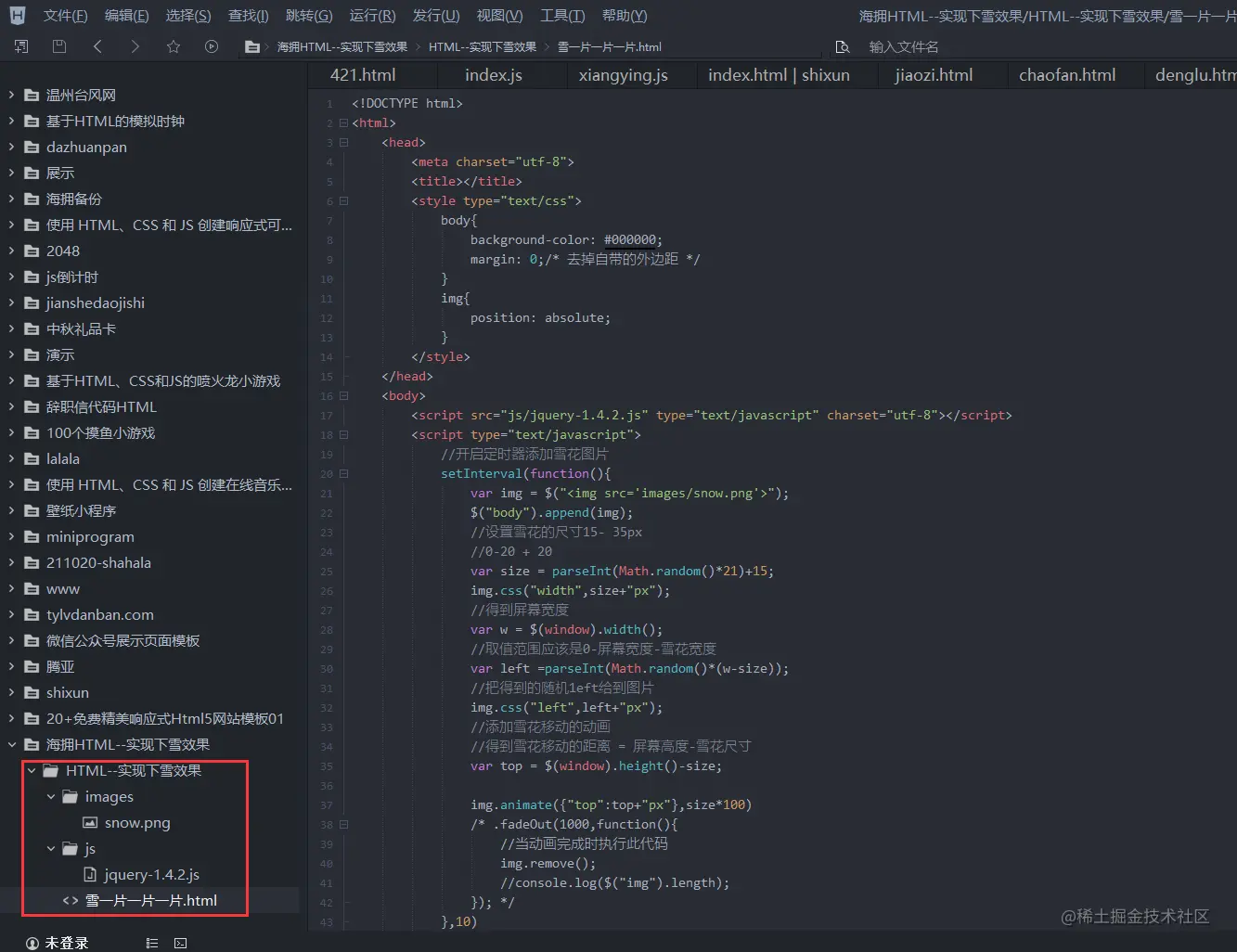

最近在负责一个大型网站的维护工作,其中一个核心任务就是定期检查网站内所有外部链接的可用性,并为站内特定内容生成一个自定义的搜索索引。最初,我尝试使用 curl 结合一些简单的循环来遍历页面,但很快就遇到了瓶颈:效率低下:同步请求导致抓取速度极慢,面对数千上万个链接,耗时巨大。错误处理复杂:网络超时、HTTP 错误码(如 404, 500)、重定向等情况层出不穷,手动编写健壮的错误处理逻辑非常繁琐。状态管理困难:哪些链接已经访问过?哪些待访问?如何从上次中断的地方继续?这些都需要复杂的逻辑来维护。资源消耗大:长时间运行的脚本容易内存溢出,或者被服务器强制中断。缺乏灵活性:如果需要解析 HTML 提取特定数据,或者遵守 robots.txt 规则,都需要从头开始编写解析器和逻辑。

我深知这种“土法炼钢”的方式不可持续,急需一个更专业、更高效的解决方案。就在我为此头疼不已时,我通过 Composer 发现了一个宝藏:terminal42/escargot。

Composer在线学习地址:学习地址

告别“土法炼钢”:拥抱 terminal42/escargot

terminal42/escargot 是一个基于 Symfony 组件构建的 PHP 网页爬虫库。它的名字“Escargot”是法语中“蜗牛”的意思,虽然名字听起来慢悠悠,但实际上它借助 Symfony HttpClient 的强大能力,实现了高效的并发抓取,性能远超你的想象。

这个库的设计理念非常清晰:提供一个灵活、可扩展的框架,让你能够轻松地爬取任何基于 HTTP 的内容,并以你喜欢的方式处理响应。它不仅仅局限于 HTML 网页,还可以作为抓取 JSON API 或其他类型内容的坚实基础。

它如何解决我的问题?

Composer 轻松安装:作为 PHP 生态的基石,Composer 让安装 terminal42/escargot 变得异常简单,只需一行命令:

composer require terminal42/escargot持久化与断点续爬:这是 Escargot 最让我惊喜的特性之一。它引入了“作业 ID(Job ID)”的概念,并且提供了多种队列实现(InMemoryQueue 用于测试,DoctrineQueue 用于持久化到数据库)。这意味着即使爬虫中途停止,也能从上次的进度继续,彻底解决了状态管理难题。

'mysql://user:password@localhost/database',];$connection = DriverManager::getConnection($connectionParams);$baseUris = new BaseUriCollection();$baseUris->add(new Uri('https://www.example.com')); // 你的起始 URI$queue = new DoctrineQueue($connection);// 创建新的爬虫实例$escargot = Escargot::create($baseUris, $queue);// 或者从已有的作业 ID 恢复:// $escargot = Escargot::createFromJobId('your-job-id', $queue);$escargot->crawl();?>高度灵活的订阅者模式(Subscribers):

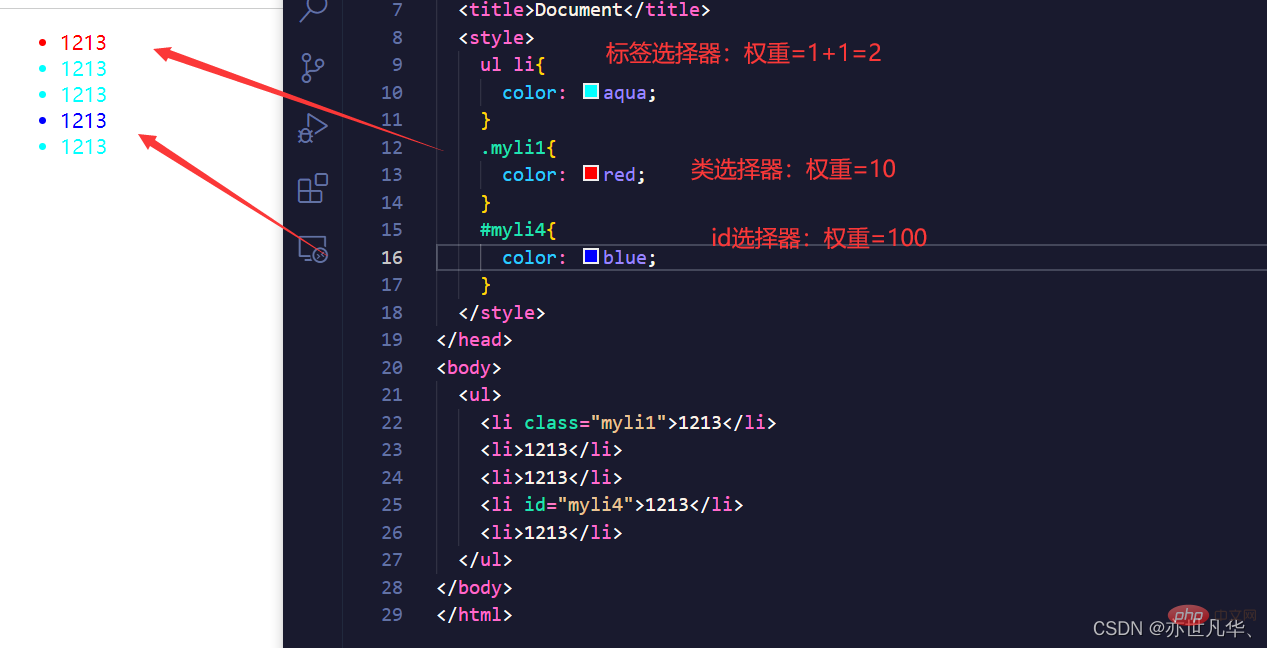

Escargot不直接返回结果,而是将抓取过程中的事件分发给“订阅者”。你可以编写自定义订阅者来决定:

shouldRequest():是否应该发送请求(例如,根据robots.txt或nofollow标签跳过某些链接)。needsContent():是否需要加载完整的响应体(例如,只抓取 HTML 页面,跳过图片等)。onLastChunk():当响应体完全加载后,如何处理数据(例如,解析 HTML 提取链接、保存内容到数据库)。库中还内置了

RobotsSubscriber和HtmlCrawlerSubscriber,它们能自动处理robots.txt、X-Robots-Tag、meta name="robots"以及从 HTML 中提取链接,大大简化了网页爬虫的开发。addSubscriber(new RobotsSubscriber());$escargot->addSubscriber(new HtmlCrawlerSubscriber());// 编写自定义订阅者来处理链接监控和内容索引class MyLinkMonitorAndIndexer implements SubscriberInterface, LoggerAwareInterface{ use LoggerAwareTrait; use SubscriberLoggerTrait; // 方便地记录日志,包含 CrawlUri 信息 public function shouldRequest(CrawlUri $crawlUri, string $currentDecision): string { // 示例:只抓取本域名下的链接,并遵守 nofollow 和 robots.txt 规则 if (!$this->escargot->getBaseUris()->containsHost($crawlUri->getUri()->getHost()) || $crawlUri->hasTag(RobotsSubscriber::TAG_NOFOLLOW) || $crawlUri->hasTag(HtmlCrawlerSubscriber::TAG_REL_NOFOLLOW) || $crawlUri->hasTag(RobotsSubscriber::TAG_DISALLOWED_ROBOTS_TXT) ) { $this->logWithCrawlUri($crawlUri, LogLevel::INFO, 'Skipping request due to rules.'); return SubscriberInterface::DECISION_NEGATIVE; } $this->logWithCrawlUri($crawlUri, LogLevel::DEBUG, 'Request allowed.'); return SubscriberInterface::DECISION_POSITIVE; } public function needsContent(CrawlUri $crawlUri, ResponseInterface $response, ChunkInterface $chunk, string $currentDecision): string { // 仅处理 HTTP 200 状态码的 HTML 内容 if (200 === $response->getStatusCode() && str_contains($response->getHeaders()['content-type'][0] ?? '', 'text/html')) { $this->logWithCrawlUri($crawlUri, LogLevel::DEBUG, 'Content needed for HTML.'); return SubscriberInterface::DECISION_POSITIVE; } $this->logWithCrawlUri($crawlUri, LogLevel::INFO, 'Content not needed or not HTML.'); return SubscriberInterface::DECISION_NEGATIVE; } public function onLastChunk(CrawlUri $crawlUri, ResponseInterface $response, ChunkInterface $chunk): void { $this->logWithCrawlUri($crawlUri, LogLevel::INFO, 'Processing content.'); // 这里可以解析 $chunk->getContent(),进行链接监控和内容索引 $content = $chunk->getContent(); $statusCode = $response->getStatusCode(); // 示例:监控外部链接状态 if (!$this->escargot->getBaseUris()->containsHost($crawlUri->getUri()->getHost())) { echo sprintf("External link: %s - Status: %dn", $crawlUri->getUri(), $statusCode); // 存储到数据库或发送通知 } else { // 示例:为站内内容创建索引 echo sprintf("Indexing internal page: %s - Length: %dn", $crawlUri->getUri(), strlen($content)); // 将 $content 传递给搜索索引库(如 Elasticsearch, Algolia) } }}$escargot->addSubscriber(new MyLinkMonitorAndIndexer());$escargot->crawl();?>强大的配置选项:

Escargot提供了丰富的配置方法,如设置并发请求数 (withConcurrency)、请求之间的延迟 (withRequestDelay)、最大请求数 (withMaxRequests)、最大运行时间 (withMaxDurationInSeconds),以及自定义 HTTP 客户端 (withHttpClient) 和日志记录器 (withLogger)。这些选项让我们可以精细控制爬虫的行为,避免对目标网站造成过大压力,同时提高自身程序的稳定性。// 设置并发数为 5,请求之间延迟 100 毫秒$escargot = $escargot->withConcurrency(5)->withRequestDelay(100000); // 100000 微秒 = 100 毫秒// 设置最大请求数 1000,或者最大运行时间 300 秒$escargot = $escargot->withMaxRequests(1000)->withMaxDurationInSeconds(300);// 引入 PSR-3 兼容的日志库,如 Monologuse MonologLogger;use MonologHandlerStreamHandler;$logger = new Logger('escargot');$logger->pushHandler(new StreamHandler('escargot.log', Logger::DEBUG));$escargot = $escargot->withLogger($logger);实际应用效果与优势

通过引入

terminal42/escargot,我不仅解决了之前遇到的所有问题,还带来了意想不到的效率提升:速度飞跃:并发请求能力让抓取效率提高了数倍,原本需要数小时的任务现在几分钟就能完成。高度可控:通过订阅者模式,我可以精确控制每个请求的生命周期,从是否发送请求到如何处理响应,一切尽在掌握。健壮性强:内置的错误处理机制和断点续爬功能,让爬虫程序更加稳定可靠,不再担心意外中断。开发效率高:得益于 Symfony HttpClient 的强大和

Escargot的抽象,我无需关注底层 HTTP 细节,可以将更多精力放在业务逻辑上。遵守规范:自动处理robots.txt和nofollow标签,让我的爬虫更加“礼貌”,降低被目标网站屏蔽的风险。

terminal42/escargot简直是 PHP 开发者在需要进行网站数据抓取和监控时的福音。它将复杂的爬虫任务分解为易于管理和扩展的组件,结合 Composer 的便捷性,让构建高性能、高可靠性的爬虫成为可能。如果你也曾被类似的爬虫问题困扰,不妨尝试一下terminal42/escargot,相信它会为你带来全新的体验!以上就是如何高效构建网站内容索引与链接监控?使用Composer引入Terminal42/Escargot轻松搞定!的详细内容,更多请关注php中文网其它相关文章!

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。

如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 chuangxiangniao@163.com 举报,一经查实,本站将立刻删除。

发布者:程序猿,转转请注明出处:https://www.chuangxiangniao.com/p/137574.html

微信扫一扫

微信扫一扫  支付宝扫一扫

支付宝扫一扫