java 框架中的大数据处理技术包括:apache hadoop:分布式处理框架,包括 hdfs(文件系统)和 mapreduce(编程模型)。apache spark:统一分析引擎,结合了 hadoop 的处理能力和内存计算。flink:分布式流处理引擎,用于处理实时数据流。

Java 框架中的大数据处理技术

随着大数据的普及,Java 开发人员需要具备处理海量数据的能力。Java 框架提供了各种技术来有效处理大数据,本篇文章将介绍一些最受欢迎的技术。

Apache Hadoop

Hadoop 是一个分布式处理框架,用于处理大数据集。它由一套工具组成,包括:

HDFS (Hadoop 分布式文件系统):存储和管理分布式文件。MapReduce:一种编程模型,用于并行处理大型数据集。

import org.apache.hadoop.conf.Configuration;import org.apache.hadoop.fs.Path;import org.apache.hadoop.io.IntWritable;import org.apache.hadoop.io.Text;import org.apache.hadoop.mapreduce.Job;import org.apache.hadoop.mapreduce.Mapper;import org.apache.hadoop.mapreduce.Reducer;import org.apache.hadoop.mapreduce.lib.input.FileInputFormat;import org.apache.hadoop.mapreduce.lib.output.FileOutputFormat;public class WordCount { public static class MyMapper extends Mapper

Apache Spark

Spark 是一个统一的分析引擎,结合了 Hadoop 的处理能力和内存计算。它提供了高级 API,简化了大数据处理。

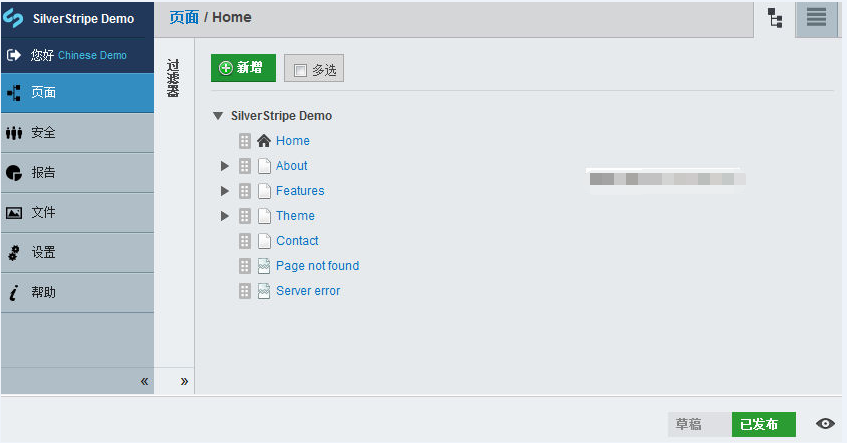

内容管理系统

内容管理系统

SilverStripe CMS是一款功能强大的CMS内容管理系统,适用于一些中小型企业建站使用,具有强大的网站设计功能,直观和友好的用户操作界面,采用MVC框架设计开发并运用了Ajax技术,易于扩展,所有页面都符合XHTML标准并基于模板生成。

486 查看详情

486 查看详情

立即学习“Java免费学习笔记(深入)”;

import org.apache.spark.api.java.JavaRDD;import org.apache.spark.api.java.JavaSparkContext;import org.apache.spark.sql.Dataset;import org.apache.spark.sql.Row;import org.apache.spark.sql.SparkSession;import org.apache.spark.sql.types.DataTypes;import org.apache.spark.sql.types.StructType;public class SparkWordCount { public static void main(String[] args) { SparkSession spark = SparkSession.builder().appName("word count").master("local").getOrCreate(); JavaSparkContext jsc = new JavaSparkContext(spark.sparkContext()); JavaRDD lines = jsc.textFile(args[0]); JavaRDD words = lines.flatMap(line -> Arrays.asList(line.split(" ")).iterator()); JavaPairRDD wordCounts = words.mapToPair(word -> new Tuple2(word, 1)).reduceByKey((a, b) -> a + b); StructType schema = DataTypes.createStructType(new StructField[] { DataTypes.createStructField("word", DataTypes.StringType, false), DataTypes.createStructField("count", DataTypes.IntegerType, false) }); Dataset df = spark.createDataFrame(wordCounts.rdd(), schema); df.show(); }}

Flink

Flink 是一个分布式流处理引擎,用于实时处理不断增长的数据集。它可以处理无限的数据流,并提供容错和低延迟。

import org.apache.flink.api.java.tuple.Tuple2;import org.apache.flink.api.java.utils.ParameterTool;import org.apache.flink.streaming.api.datastream.DataStream;import org.apache.flink.streaming.api.environment.StreamExecutionEnvironment;import org.apache.flink.streaming.api.windowing.time.Time;public class FlinkWordCount { public static void main(String[] args) throws Exception { StreamExecutionEnvironment env = StreamExecutionEnvironment.getExecutionEnvironment(); ParameterTool params = ParameterTool.fromArgs(args); String input = params.has("input") ? params.get("input") : "data.txt"; DataStream text = env.readTextFile(input); DataStream<Tuple2> counts = text .flatMap(line -> Arrays.asList(line.split(" ")).iterator()) .map(word -> Tuple2.of(word, 1)) .keyBy(0) .timeWindow(Time.seconds(1)) .sum(1); counts.print().setParallelism(1); env.execute(); }}

以上就是java框架中的大数据处理技术有哪些?的详细内容,更多请关注创想鸟其它相关文章!

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。

如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 chuangxiangniao@163.com 举报,一经查实,本站将立刻删除。

发布者:程序猿,转转请注明出处:https://www.chuangxiangniao.com/p/828540.html

微信扫一扫

微信扫一扫  支付宝扫一扫

支付宝扫一扫