peech

-

强化学习中的Transformer发展到哪一步了?清华、北大等联合发布TransformRL综述

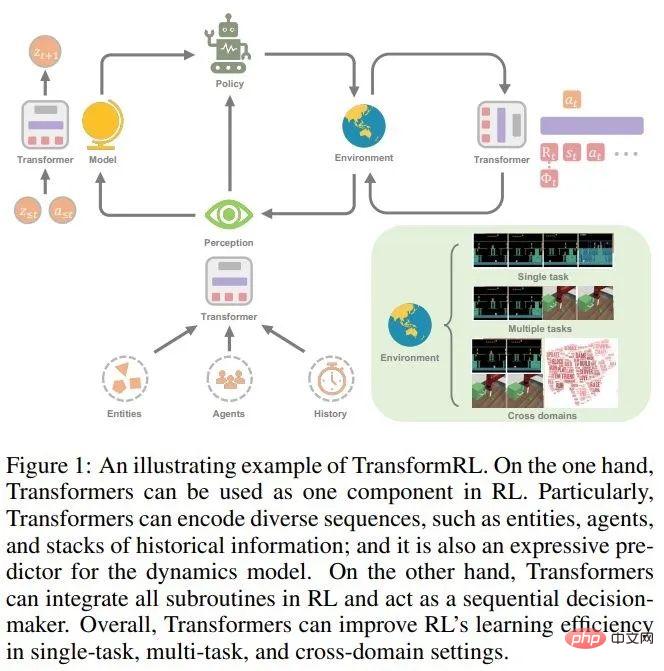

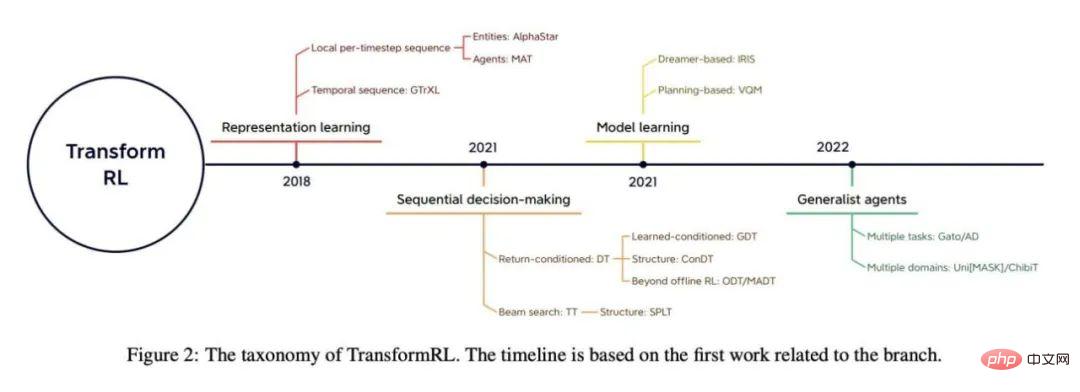

强化学习(RL)为顺序决策提供了一种数学形式,深度强化学习(DRL)近年来也取得巨大进展。然而,样本效率问题阻碍了在现实世界中广泛应用深度强化学习方法。为了解决这个问题,一种有效的机制是在 DRL 框架中引入归纳偏置。 在深度强化学习中,函数逼近器是非常重要的。然而,与监督学习(SL)中的架构设计相…

-

通过ChatGPT获利的十种简单的入门方法

☞☞☞AI 智能聊天, 问答助手, AI 智能搜索, 免费无限量使用 DeepSeek R1 模型☜☜☜ ChatGPT如今成为互联网上的流行术语,每个人都喜欢它,这是因为OpenAI公司发布的这款聊天机器人可以做各种事情。 ChatGPT聊天机器人其实是人工智能系统的一个分支,旨在理解和生成类似人…

-

谷歌打响全面反击战!官宣AI重构搜索、新模型比肩GPT-4,朝着ChatGPT微软开炮

万众瞩目,谷歌的反击来了。 现在,谷歌搜索终于要加入AI对话功能了,排队通道已经开放。 ☞☞☞AI 智能聊天, 问答助手, AI 智能搜索, 免费无限量使用 DeepSeek R1 模型☜☜☜ 当然这还只是第一步。 大的还在后面: 全新大语言模型PaLM 2正式亮相,谷歌声称它在部分任务超越GPT-…

-

陈根:Meta先下手为强推出AI大模型MMS

文/陈根 你懂几国语言?据相关资料显示,世界上一共有7000多种语言。但是,我们懂的可能就只有几种或者几十种。而目前的计算机语音识别技术所能覆盖的则有100多种。这对于很多人来说,已经是天文级的数字了。但Meta新开源的语言模型却有着更大的突破。 自从和OpenAI、Google分道扬镳之后,Met…

-

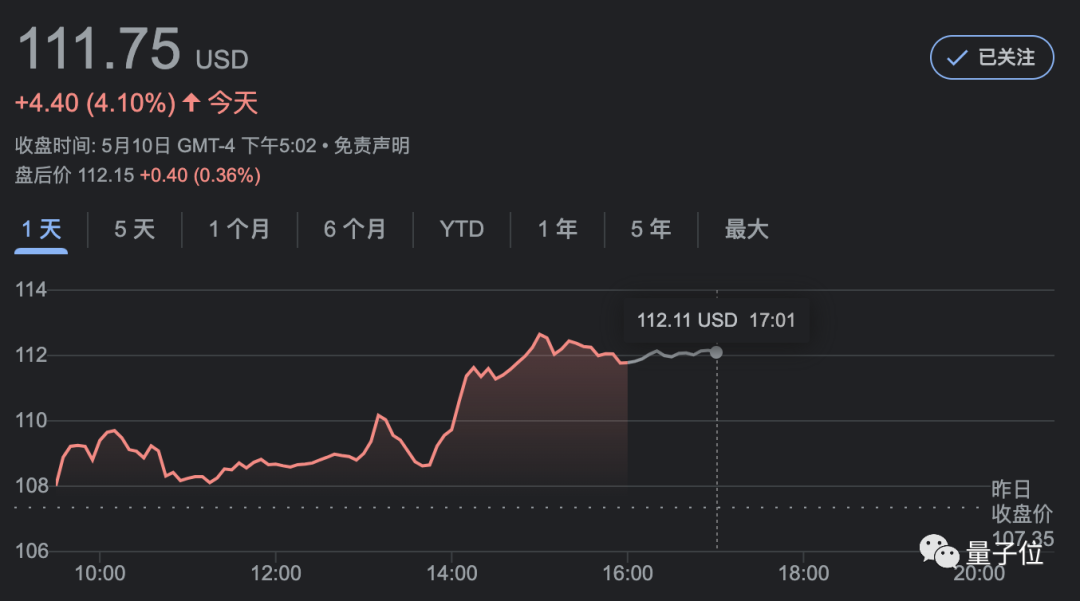

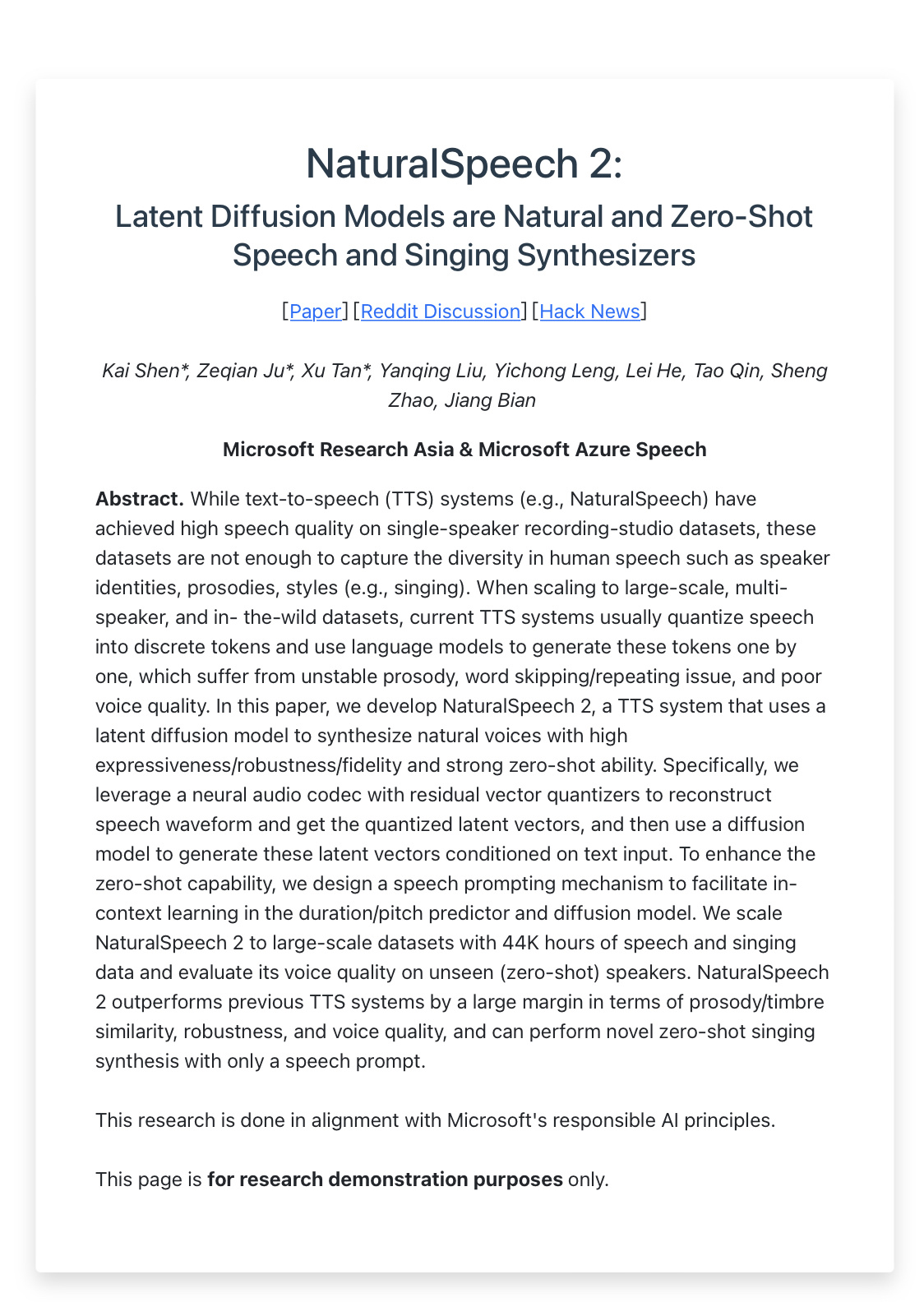

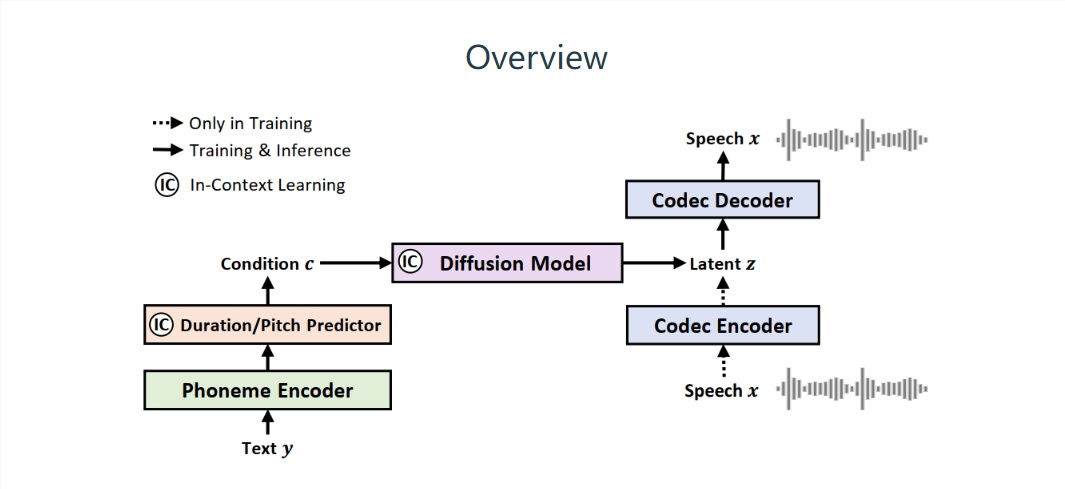

微软最新推出的NaturalSpeech2语音合成模型:提供更准确的语音重构,避免棒读效果

☞☞☞AI 智能聊天, 问答助手, AI 智能搜索, 免费无限量使用 DeepSeek R1 模型☜☜☜ 7 月 27 日消息,微软日前推出了一款名为 naturalspeech2 的语音模型,该模型采用“潜在扩散”式设计,在零样本语音合成层面效果出众,微软宣称该模型提供了“商业级”的语音 / 歌唱…

-

OpenAI成功在中国注册”GPT-5″商标,此前已在美国提出申请

根据国家知识产权局商标局官网的信息,欧爱运营有限责任公司(openai opco, llc)在上个月底申请注册了两个商标“gpt-5”,分别属于国际分类的9类和42类(科学仪器、设计研究),目前商标的状态为正在申请中 ☞☞☞AI 智能聊天, 问答助手, AI 智能搜索, 免费无限量使用 DeepSe…

-

微软与 Project Gutenberg 合作,利用 AI 制作 5000 本免费有声书

it之家 9 月 12 日消息,微软近日与“免费数字图书馆计划”project gutenberg 合作,利用 ai 为电子书库制作了超过 5000 本免费有声书。 ☞☞☞AI 智能聊天, 问答助手, AI 智能搜索, 免费无限量使用 DeepSeek R1 模型☜☜☜ ▲ 图源 Project G…

-

语音合成技术中的语音流畅性问题

☞☞☞AI 智能聊天, 问答助手, AI 智能搜索, 免费无限量使用 DeepSeek R1 模型☜☜☜ 语音合成技术中的语音流畅性问题与代码示例 引言:语音合成技术是一项涉及到语音信号处理、自然语言处理和机器学习等领域的复杂任务。其中之一的语音流畅性问题是指生成的合成语音是否听起来自然、流畅、连贯…

-

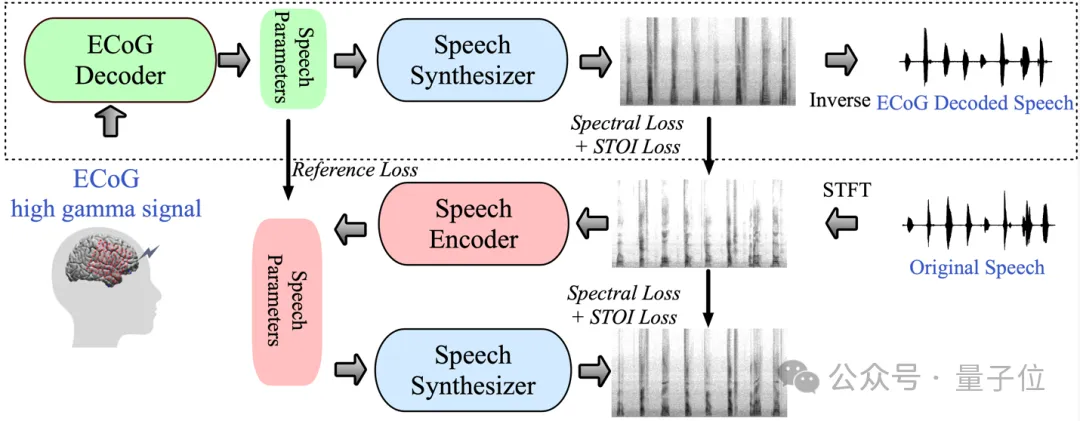

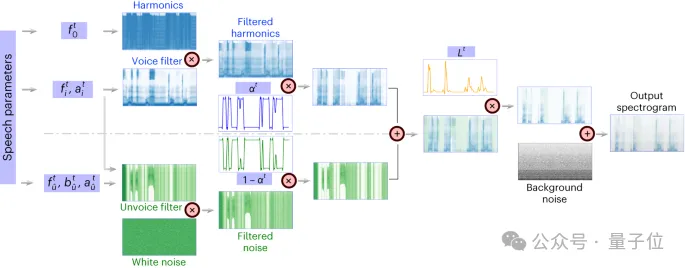

脑电合成自然语音!LeCun转发Nature子刊新成果,代码开源

脑机接口最新进展登上nature子刊,深度学习三巨头之一的lecun都来转发。 ☞☞☞AI 智能聊天, 问答助手, AI 智能搜索, 免费无限量使用 DeepSeek R1 模型☜☜☜ 这次是用神经信号进行语音合成,帮助因神经系统缺陷导致失语的人群重新获得交流的能力。 据悉,来自纽约大学的研究团队开…

-

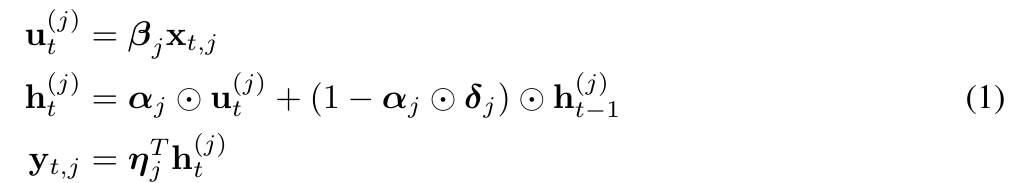

Meta无限长文本大模型来了:参数仅7B,已开源

谷歌之后,Meta 也来卷无限长上下文。 transformers的二次复杂度和弱长度外推限制了它们扩展到长序列的能力,虽然存在线性注意力力和状态空间模型等次二次解决方案,但从以往经验来看,它们在预训练效率和下游任务准确性方面表现不佳。 近日,谷歌提出的Infini-Transformer引入了有效…