核心思路是分块读取避免内存溢出。通过fopen()和fread()逐块读取文件,结合feof()判断结尾,每次处理固定大小的数据块,防止使用file_get_contents()等一次性加载方法导致内存耗尽,适用于大日志、CSV等文件处理场景。

处理PHP中的大文件读取,核心思路就是避免一次性将整个文件加载到内存中,而是将其拆分成若干小块(chunk)逐一读取和处理。这就像吃一个巨大的披萨,你不会一口吞下,而是切成小块慢慢享用。这样可以有效避免内存溢出(Out Of Memory, OOM)的错误,尤其是在处理GB级别甚至更大的日志文件、CSV数据或媒体文件时,这种分块读取的方式几乎是唯一的选择。它不仅能让你的脚本稳定运行,还能在资源有限的环境下保持较好的性能表现。

解决方案

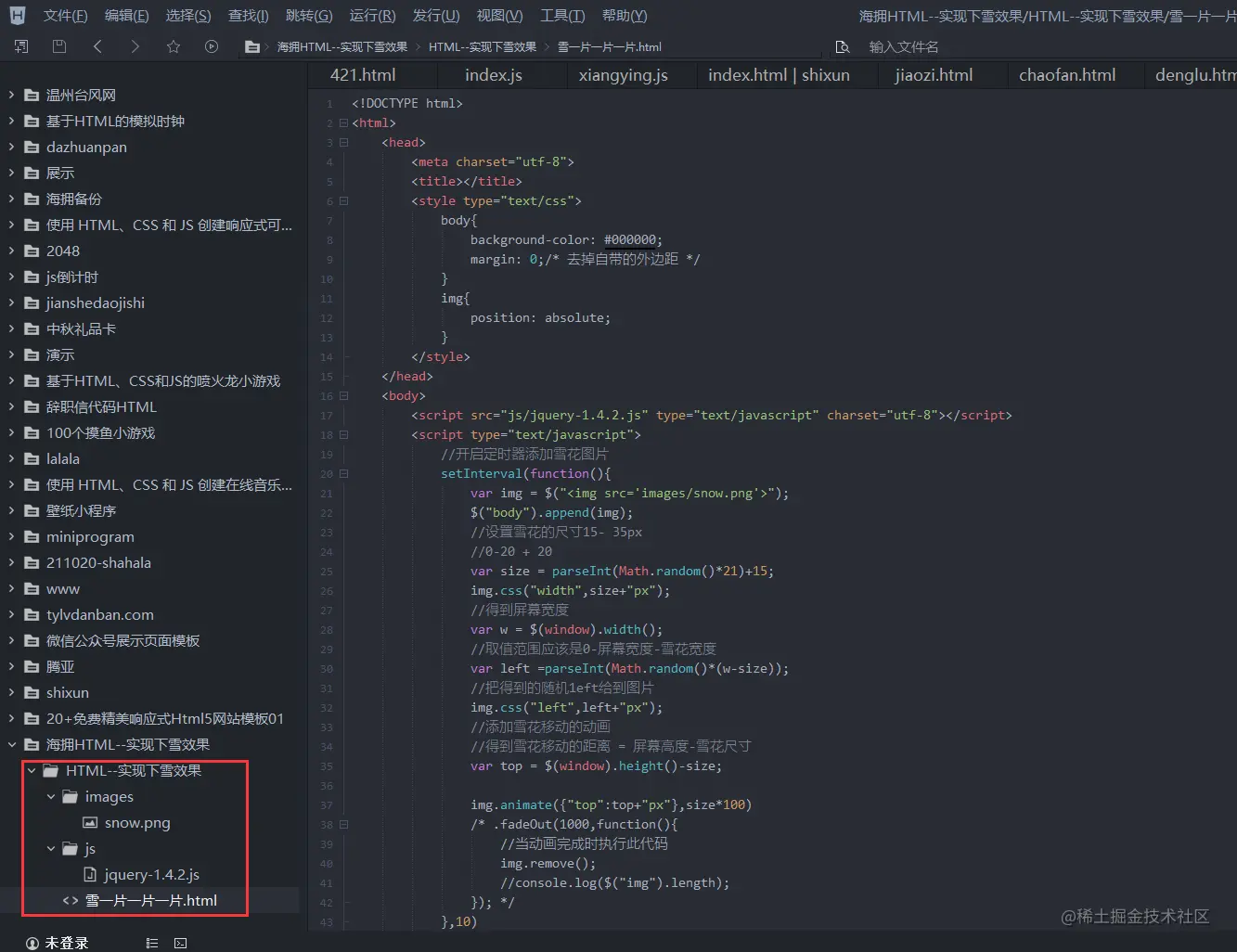

要实现PHP大文件的分块读取,我们主要依赖

fopen()

打开文件句柄,

fread()

读取指定长度的数据,以及

fseek()

(可选,用于定位)和

fclose()

关闭句柄。下面是一个基本的工作流程和代码示例:

这个函数的核心在于

while (!feof($handle))

循环和

fread($handle, $chunkSize)

。

feof()

检查文件指针是否在文件末尾,

fread()

则从当前指针位置读取指定字节数的数据,并将文件指针向前移动。这样,每次循环我们只处理一小部分数据,大大降低了内存压力。

为什么处理大文件时,传统的

file_get_contents

或

file()

方法会失效?

这个问题,我想很多PHP开发者都踩过坑。当文件体量不大时,

file_get_contents()

或

file()

用起来简直不要太爽,一行代码搞定。但一旦文件达到几十兆、几百兆甚至上G,你的脚本多半会直接抛出

Allowed memory size of X bytes exhausted

的错误。

立即学习“PHP免费学习笔记(深入)”;

原因很简单,也很直接:

file_get_contents()

会尝试将整个文件的内容一次性读取到PHP的内存中作为一个字符串变量。而

file()

函数更狠,它会把文件的每一行都作为一个数组元素加载到内存中。想象一下,一个1GB的文件,

file_get_contents()

需要至少1GB的内存来存储这个字符串;如果这个文件有几百万行,

file()

函数就会创建一个包含几百万个元素的数组,这同样会迅速耗尽PHP脚本配置的内存上限(通常是128MB或256MB)。

这就像你试图把整个太平洋的水一次性倒进一个杯子里。杯子太小,水太多,结果就是溢出。PHP脚本的内存限制就是那个杯子,而大文件就是太平洋。分块读取的精髓,就是每次只舀一勺水,这样无论太平洋有多大,你都能一点点地处理完。

选择合适的分块大小(chunk size)有哪些考量?

选择一个“合适”的分块大小,这其实是个权衡的艺术,没有一刀切的最佳答案。它受到好几个因素的影响,在我看来,主要有以下几点:

内存限制(Memory Limit):这是最直接的约束。你的

chunkSize

肯定不能超过你PHP脚本的

memory_limit

设置。当然,你还需要为PHP脚本本身的其他变量和操作预留内存,所以通常会远小于

memory_limit

。I/O性能(Input/Output Performance):过小:如果

chunkSize

太小,比如只有几十字节,那么

fread()

函数会被频繁调用,每次调用都会涉及到文件系统的I/O操作和PHP内部的函数调用开销。这会导致大量的系统调用,反而降低整体读取速度。过大:如果

chunkSize

过大,虽然减少了

fread()

的调用次数,但每次读取的数据量变大,如果你的后续处理逻辑本身就很耗内存,依然有内存溢出的风险。处理逻辑的复杂度:你读取到

$chunk

之后,打算怎么处理它?如果你只是简单地把数据写到另一个文件,那么可以适当增大

chunkSize

,因为写入操作通常不会额外消耗太多内存。如果你需要对

$chunk

进行复杂的字符串解析(比如查找特定模式、替换),或者将其分割成行进行进一步处理,那么你需要考虑这些处理过程本身可能产生的额外内存开销。比如,

explode("n", $chunk)

会创建另一个数组,这会占用更多内存。文件类型和内容:对于纯文本文件,比如日志或CSV,通常会按行处理。即使是分块读取,你可能还需要在每个

$chunk

内部寻找换行符,以确保每次处理的都是完整的行。这就需要额外的逻辑来处理跨块的行(即一行数据被分成了两个块)。系统资源:服务器的CPU、磁盘速度也会影响最佳

chunkSize

。在SSD上,I/O开销相对较小,可以尝试更大的块。

经验法则:我个人经验是,一个比较通用的起始点可以是1MB到4MB(

1024 * 1024

到

4 * 1024 * 1024

字节)。这个范围通常能在减少I/O调用和避免内存溢出之间找到一个不错的平衡点。当然,最终还是需要根据你的实际文件大小、服务器配置和具体处理逻辑进行测试和微调。有时候,如果你知道每行数据长度大致固定,也可以考虑根据行数来计算一个动态的

chunkSize

,但这会复杂一些。

分块读取大文件后,如何进一步处理和优化数据?

仅仅分块读取文件内容只是第一步,更关键的是读取到数据块后,我们如何高效、稳健地处理它们。这部分通常是整个大文件处理流程中最耗时、也最容易出问题的地方。

行式处理与边界问题:如果你的大文件是结构化的文本文件,比如CSV、日志文件,你很可能需要逐行处理。问题在于,

fread()

读取的块可能在行的中间截断。

解决方案:一个常见的做法是,在每次读取到一个

$chunk

后,找到最后一个完整的换行符(

n

),处理这部分完整的行。剩下的不完整部分(即下一行的开头)则保留,与下一个

$chunk

的开头拼接起来,再进行处理。这需要一个缓冲区来存储跨块的数据。

示例思路:

// 假设 $buffer 存储了上一个chunk末尾不完整的行$dataToProcess = $buffer . $chunk;$lines = explode("n", $dataToProcess);$buffer = array_pop($lines); // 最后一个元素可能是不完整的行,存入bufferforeach ($lines as $line) { if (!empty(trim($line))) { // 处理完整的行数据 }}// 当文件读取完毕后,如果 $buffer 不为空,还需要处理最后剩下的内容

数据解析与转换:一旦获得完整的行或数据片段,你需要将其解析成结构化的数据。

CSV文件:使用

str_getcsv()

或更强大的

fgetcsv()

(如果直接用

SplFileObject

按行读取的话)。JSON/XML文件:如果文件内容是流式的JSON或XML(每个块包含一个或多个完整对象),则可以使用相应的解析器。但如果是整个文件是一个巨大的JSON/XML,分块读取后需要更复杂的流式解析库。日志文件:使用正则表达式(

preg_match

)或字符串函数(

strpos

,

substr

)来提取关键信息。

数据持久化与批量操作:将处理后的数据存入数据库是最常见的后续操作。

批量插入(Batch Insert):避免每处理一行就执行一次数据库插入。这会产生大量的数据库连接和I/O开销。更好的做法是,将处理好的数据暂存在一个数组中,当数组达到一定数量(比如1000行、5000行)时,一次性构建一个大的

INSERT INTO ... VALUES (), (), ()

语句进行批量插入。这能显著提高数据库写入性能。事务处理:对于批量操作,考虑使用数据库事务,确保数据的一致性。如果批量插入过程中出现错误,可以回滚整个批次。

异步处理与消息队列:如果数据处理非常耗时,或者需要与其他服务交互,可以考虑将处理任务推送到消息队列(如RabbitMQ, Kafka, Redis List)。

流程:PHP脚本负责分块读取文件,解析出关键数据,然后将这些数据(或指向数据的指针)作为消息发送到队列。优势:后台的消费者(Worker)进程可以异步地从队列中获取任务并进行处理,这使得文件上传/导入操作能够快速响应用户,避免脚本超时。同时,可以通过增加消费者数量来横向扩展处理能力。

资源管理:别忘了,每次打开文件句柄,用完后一定要

fclose()

。虽然PHP脚本执行完毕会自动关闭所有打开的句柄,但在长时间运行的脚本或处理大量文件时,及时关闭能避免资源泄露。

总的来说,分块读取只是一个起点,它为我们提供了一个处理大文件的基础。在此基础上,结合实际业务需求,通过巧妙的行处理、高效的数据解析、批量化的持久化以及可能的异步处理,才能构建出一个真正健壮、高性能的大文件处理系统。

以上就是PHP怎么分块读取大文件_PHP大文件分块读取处理教程的详细内容,更多请关注php中文网其它相关文章!

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。

如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 chuangxiangniao@163.com 举报,一经查实,本站将立刻删除。

发布者:程序猿,转转请注明出处:https://www.chuangxiangniao.com/p/69348.html

微信扫一扫

微信扫一扫  支付宝扫一扫

支付宝扫一扫