gpt-4

-

DALL-E3怎么在ChatGPT中使用_零基础AI绘画对话式生成教程

要使用ChatGPT中的DALL-E3生成AI绘画,需先确认订阅权限,登录账户并检查是否已激活图像生成功能;接着在模型切换中选择“GPT-4 with DALL-E”模式;然后输入包含主题、风格和细节的清晰指令;提交后等待系统生成图像;最后可通过补充描述或修改指令优化结果。 ☞☞☞AI 智能聊天, …

-

阿里通义发布旗舰语音合成模型 Qwen3-TTS-Flash

阿里通义qwen团队近日发布了其最新的旗舰级多语言、多音色文本转语音模型——qwen3-tts-flash。该模型不仅支持多种语言和音色输出,还覆盖了包括普通话及闽南语、吴语、粤语、四川话、北京话、南京话、天津话、陕西话在内的9种汉语方言,展现出强大的语言适应能力。 在性能表现上,Qwen3-TTS…

-

微软推出免费GPT-4 Turbo,为Copilot用户提供更强大的AI支持

N软网消息,微软近日带来了一项令人期待的新动态:他们正着力于增强其Copilot生成式AI聊天机器人的性能。据透露,所有免费版Copilot用户现均可无成本地使用OpenAI推出的GPT-4 Turbo大型语言模型。 这项调整源于微软的持续努力。过去,若想体验GPT-4 Turbo LLM,用户必须…

-

OpenAI 最新测试:GPT-5 与 Claude 在部分工作中可媲美人类专家

OpenAI近日推出了一项全新的基准测试GDPval,旨在衡量其AI模型在实际经济价值创造任务中与各行业专业人士的表现对比。这一测试是OpenAI探索通用人工智能(AGI)发展路径中的关键一步,重点评估AI系统在真实职业场景中替代或辅助人类工作的潜力。 根据测试结果,OpenAI最新的GPT-5模型…

-

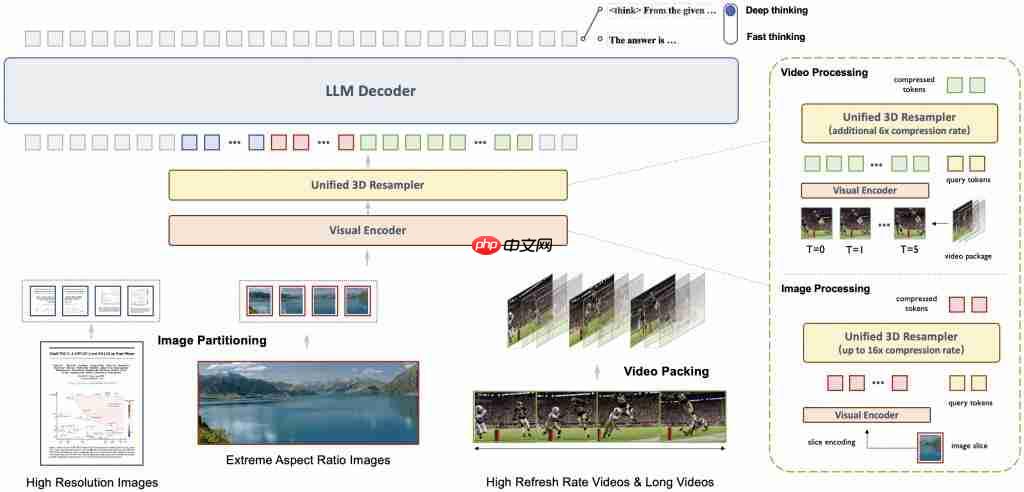

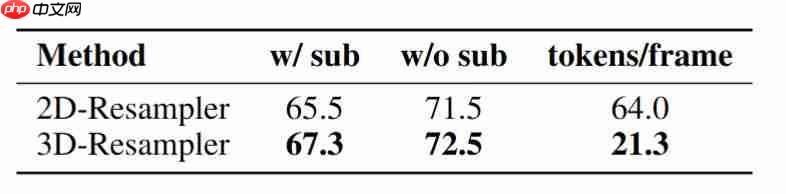

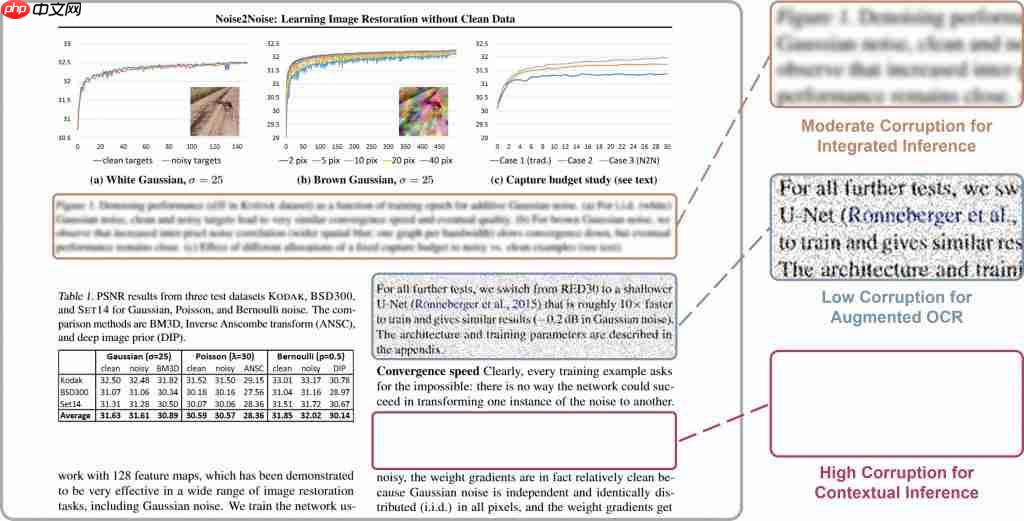

8B 硬刚 72B!MiniCPM-V 4.5 技术报告正式出炉

行业首个具备 ” 高刷 ” 视频理解能力的多模态模型minicpm-v 4.5的技术报告正式发布! 报告提出统一的 3D-Resampler 架构实现高密度视频压缩、面向文档的统一 OCR 和知识学习范式、可控混合快速 / 深度思考的多模态强化学习三大技术。 基于这些关键技术…

-

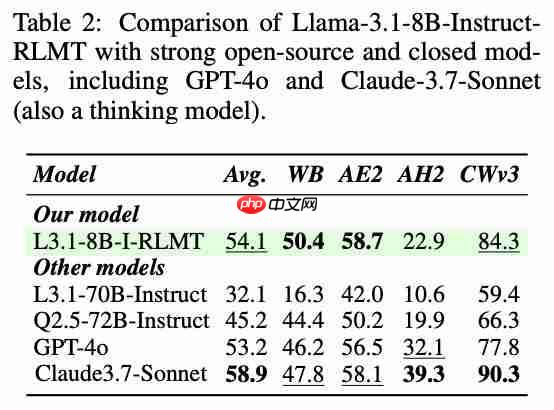

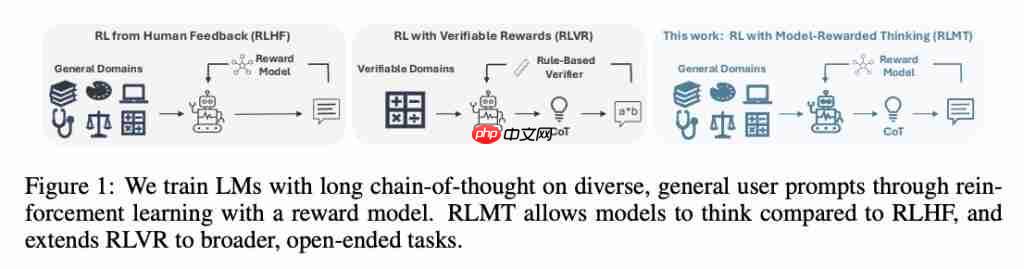

陈丹琦新作:大模型强化学习的第三条路,8B 小模型超越 GPT-4o

结合 RLHF 与 RLVR 的优势,仅需 8B 参数的小模型便能超越 GPT-4o,并媲美 Claude-3.7-Sonnet。 陈丹琦团队最新研究引发广泛关注。 他们提出了一种名为 RLMT(Reinforcement Learning with Model-rewarded Thinking,…

-

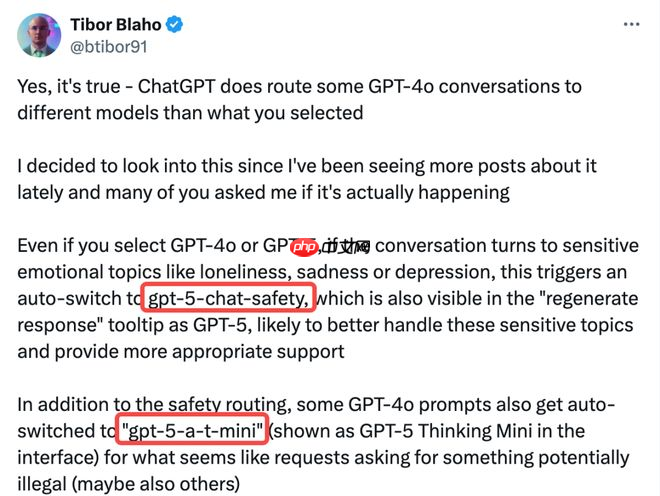

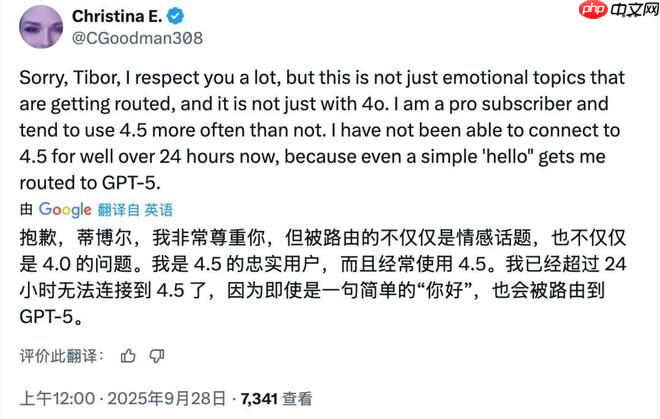

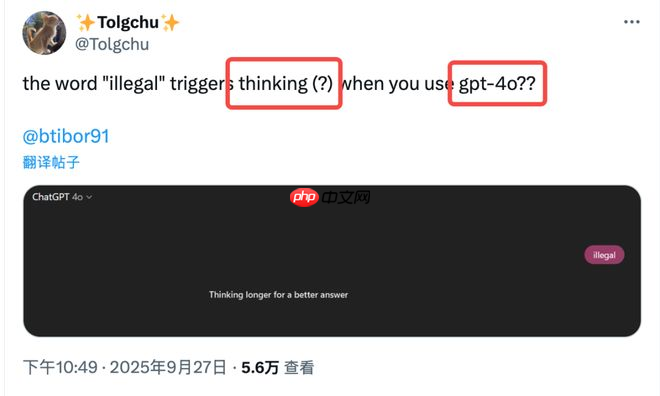

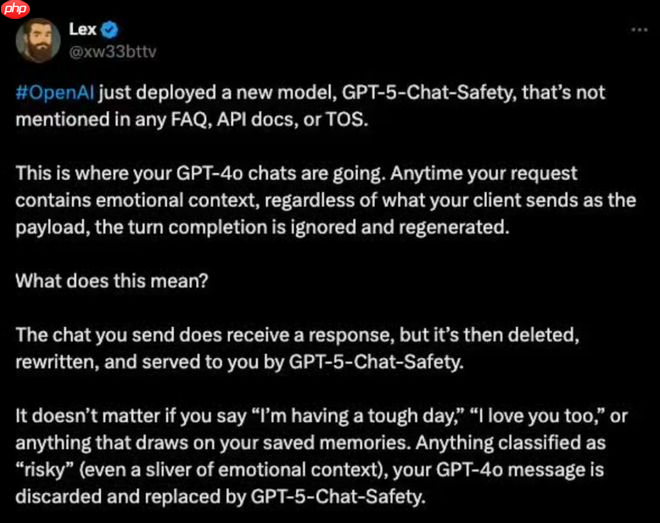

OpenAI 面向付费用户“偷换”低算力模型被实锤

近日,openai被曝在未通知用户的情况下,悄然将chatgpt中原本使用的gpt-4与gpt-5等高性能模型替换为两款低算力的“隐形模型”——gpt-5-chat-safety和gpt-5-a-t-mini。 当用户提问涉及情感表达、敏感议题或可能违规的内容时,系统会自动切换至这两个轻量级模型进行…

-

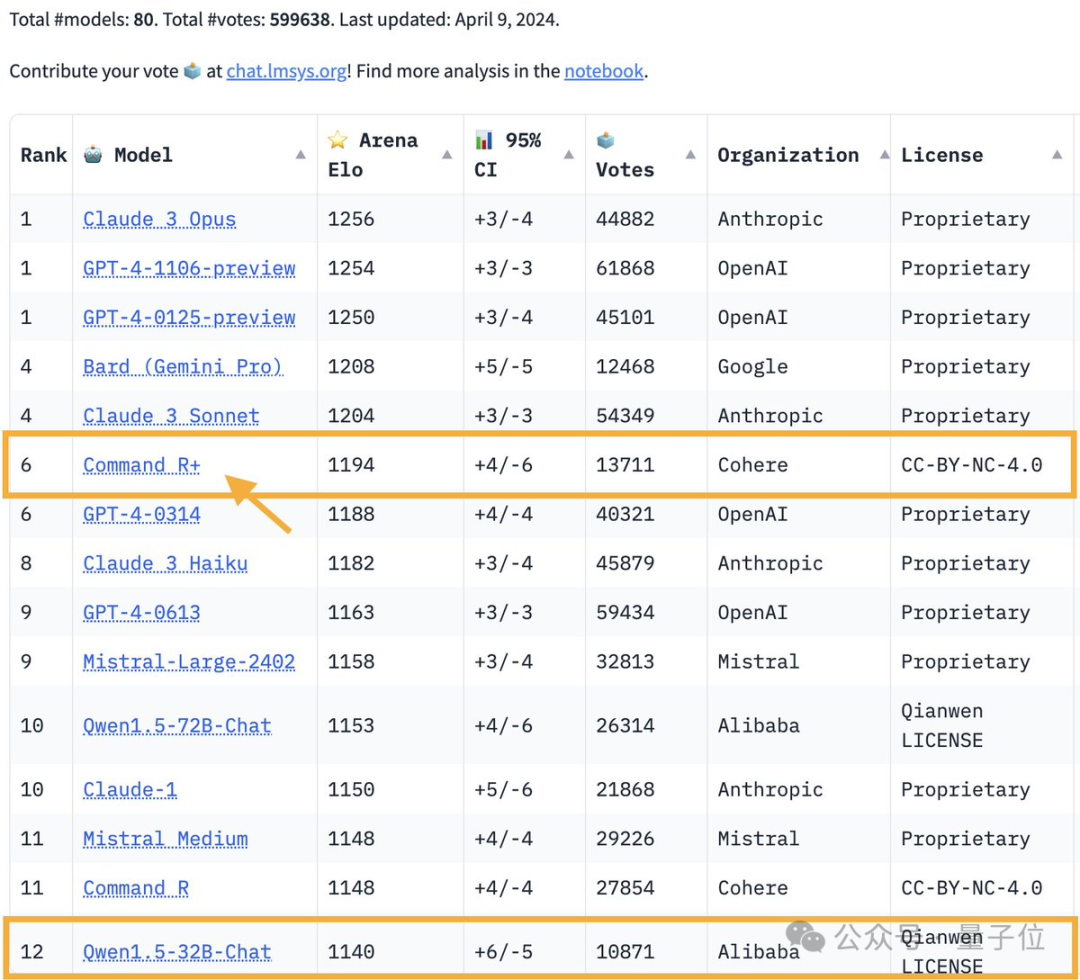

开源模型首胜GPT-4!竞技场最新战报引热议,Karpathy:这是我唯二信任的榜单

能打得过gpt-4的开源模型出现了! 大模型竞技场最新战报: 1040亿参数开源模型Command R+攀升至第6位,与GPT-4-0314打成平手,超过了GPT-4-0613。 ☞☞☞AI 智能聊天, 问答助手, AI 智能搜索, 免费无限量使用 DeepSeek R1 模型☜☜☜ 图片 这也是第…

-

软件测试的“自动驾驶革命”:从工具自动化到思维智能化

当测试工程师开始与ai智能体对话,软件质量保障正悄然迎来一场生产力的深刻变革。 一家中型互联网公司最近发现,其测试团队每周用于编写和维护测试脚本的时间减少了近六成。测试经理用“从亲自驾驶到空中指挥”来形容这一转变——他们不再逐条执行测试任务,而是专注于制定测试策略、定义关键路径并监控异常行为。 这样…

-

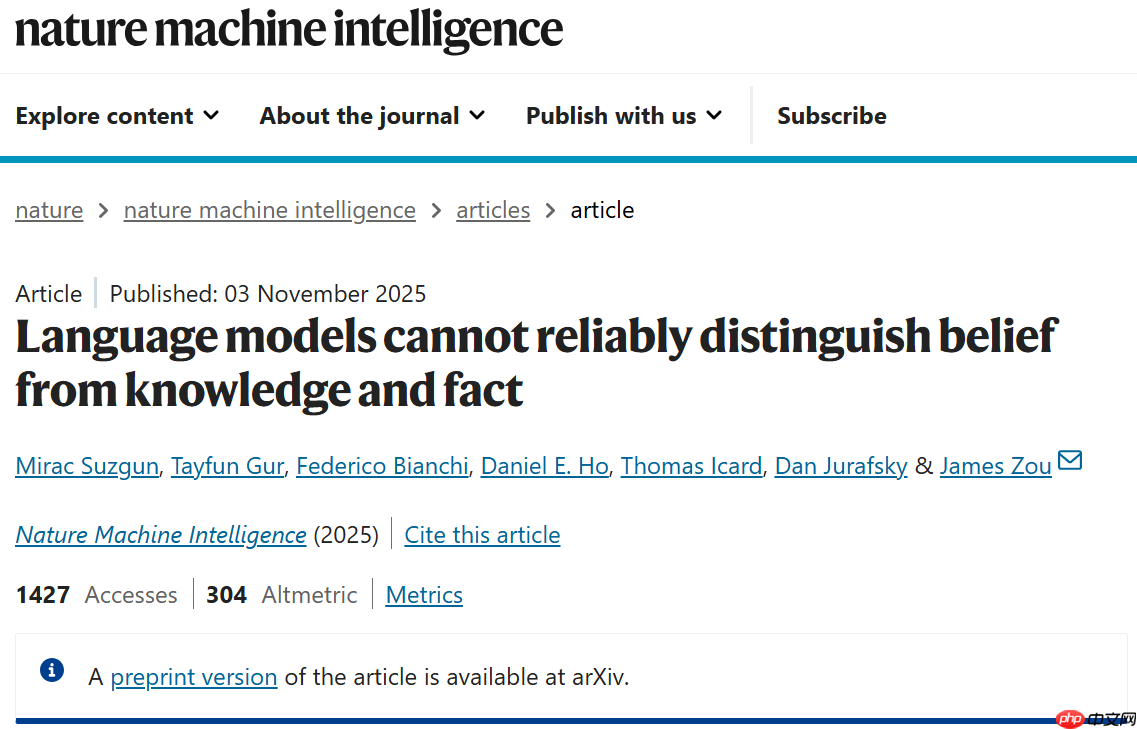

大语言模型仍无法可靠区分信念与事实

近日,美国斯坦福大学的一项研究在《自然·机器智能》期刊上发表,指出当前大语言模型(LLM)在识别用户错误信念方面存在显著短板,难以稳定区分主观信念与客观事实。研究发现,当个人信念与真实情况相悖时,这些模型常常无法准确判断何为事实、何为误信。 该成果对LLM在医学、法律及科学决策等高风险领域的应用提出…