内存占用

-

Python 如何高效比对两个文件是否相同

判断文件是否相同可通过哈希比对、filecmp模块、分块比对和元信息预筛实现,分别适用于大文件、简单场景、超大文件和批量处理,兼顾效率与准确性。 判断两个文件是否相同,关键在于准确与效率的平衡。直接读取全部内容对比虽然简单,但对大文件不友好。以下是几种高效且实用的方法。 1. 使用文件哈希值比对 通…

-

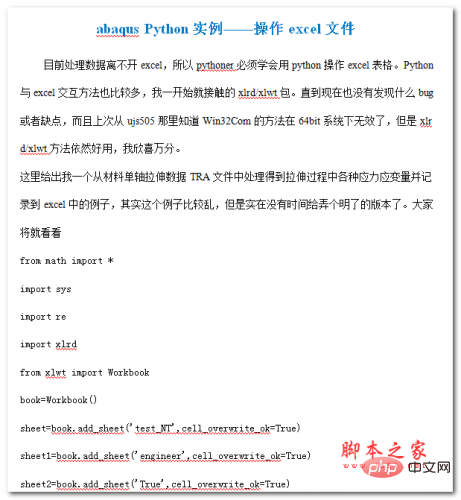

Python 处理 Excel 文件的常见库 openpyxl

openpyxl是Python操作.xlsx文件的库,支持读写单元格、样式、多工作表等;安装后可加载或创建文件,读取数据、写入内容、设置字体对齐、管理多个sheet,适用于无需Excel软件的数据处理。 openpyxl 简介 openpyxl 是 Python 中用于读写 Excel 2010 及…

-

Python中反转嵌套字典:内存高效的视图实现

本文旨在探讨在python中高效反转嵌套字典的方法,尤其针对处理大规模数据时可能遇到的内存限制。我们将介绍一个基于`collections.userdict`的`reversedict`类,该类通过实现按需访问和利用生成器,提供一个内存优化的反转字典视图,从而有效避免将整个反转后的字典加载到内存中。…

-

高效处理大量CSV文件:Pandas DataFrame分块与多线程优化

本文针对循环读取并合并大量CSV文件至Pandas DataFrame时效率低下的问题,提供了基于数据收集和多线程的优化方案。通过将数据暂存至字典后一次性合并,以及利用`ThreadPoolExecutor`实现并行读取,显著提升数据处理速度,并附带代码示例和注意事项。 在数据分析和处理过程中,经常…

-

高效处理大量CSV文件:Pandas循环优化与多线程应用

本文旨在解决在循环中处理大量CSV文件时遇到的性能瓶颈问题,重点介绍如何通过避免在循环中使用`concat`操作,以及利用Python字典和`pandas.concat`函数进行优化。此外,还探讨了使用多线程并行处理CSV文件以进一步提升效率的方法,并提供详细的代码示例和解释。 Pandas循环处理…

-

使用 Pandas 并行处理多个列:高效统计满足条件的行数

本文介绍如何使用 Pandas 快速统计 DataFrame 中多个列满足特定条件的行数,并提供向量化方法和并行处理的思路,以提高数据处理效率。重点讲解如何利用 Pandas 内置函数进行高效计算,避免不必要的循环,并探讨并行处理的潜在成本。 在数据分析中,经常需要对 DataFrame 中的多个列…

-

Python高效反转大型嵌套字典:基于UserDict的内存优化实现

本文旨在探讨如何在python中高效地反转嵌套字典的结构,即将`外层键: {内层键: 值}`转换为`内层键: {外层键: 值}`。针对处理大型数据集时可能出现的内存溢出问题,文章将介绍一种基于`collections.userdict`和生成器模式的内存优化方案,通过实现一个只读的`reversed…

-

python递归算法是什么

递归是函数调用自身的编程方法,需满足基线条件和递归条件。如阶乘函数通过n=0或1停止递归,否则调用factorial(n-1)。优点是代码简洁、逻辑清晰,适合树结构与分治问题;缺点是效率低、易触发RecursionError、内存占用高。可通过记忆化(如@lru_cache)或改写为迭代优化性能。掌…

-

利用 Pandas DataFrame 并行处理多列数据

本文旨在介绍如何高效地利用 Pandas DataFrame 对大量列数据进行并行处理,以提升数据分析和处理速度。我们将探讨如何使用向量化操作来替代传统的循环方法,从而显著提高性能,并提供具体代码示例和注意事项。 在使用 Pandas DataFrame 处理大量数据时,经常需要对多个列执行相同的操…

-

Python从大型文件高效随机选取固定长度单词教程

本教程旨在解决从大型文件中高效随机选取固定长度单词的问题,避免将整个文件加载到内存中造成的性能和内存开销。我们将详细介绍如何利用python的文件指针定位(`f.seek()`)功能,结合随机数生成,直接跳转到文件中的特定位置并读取单词,同时强调该方法的适用条件、潜在限制及最佳实践。 在开发需要从大…