模型

-

向完全自主性更进一步,清华、港大全新跨任务自我进化策略让智能体学会「以经验为鉴」

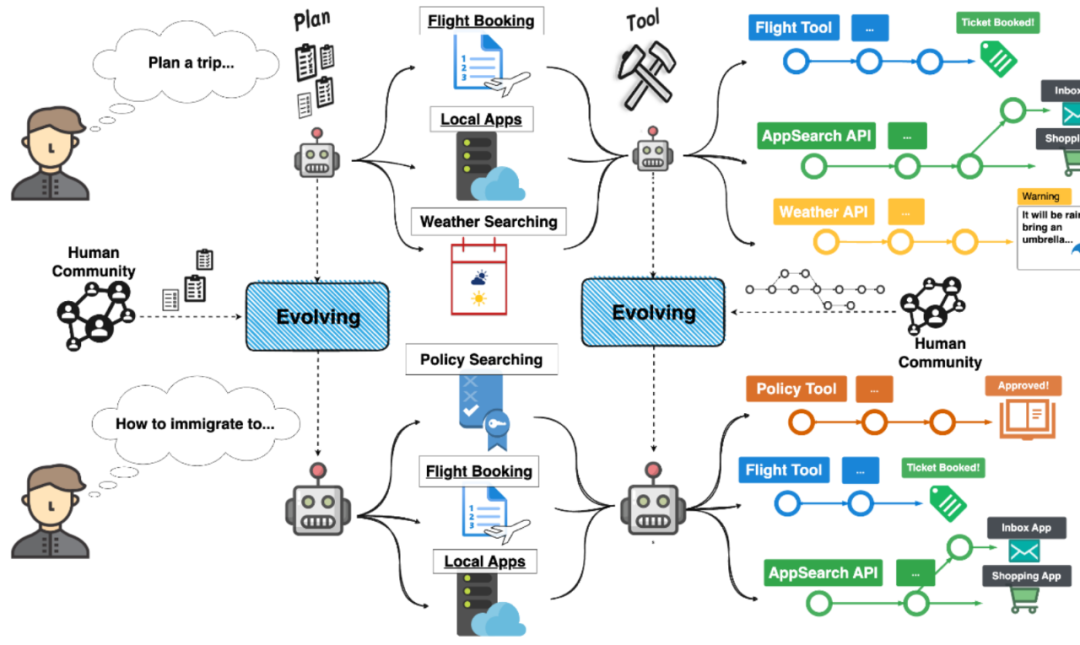

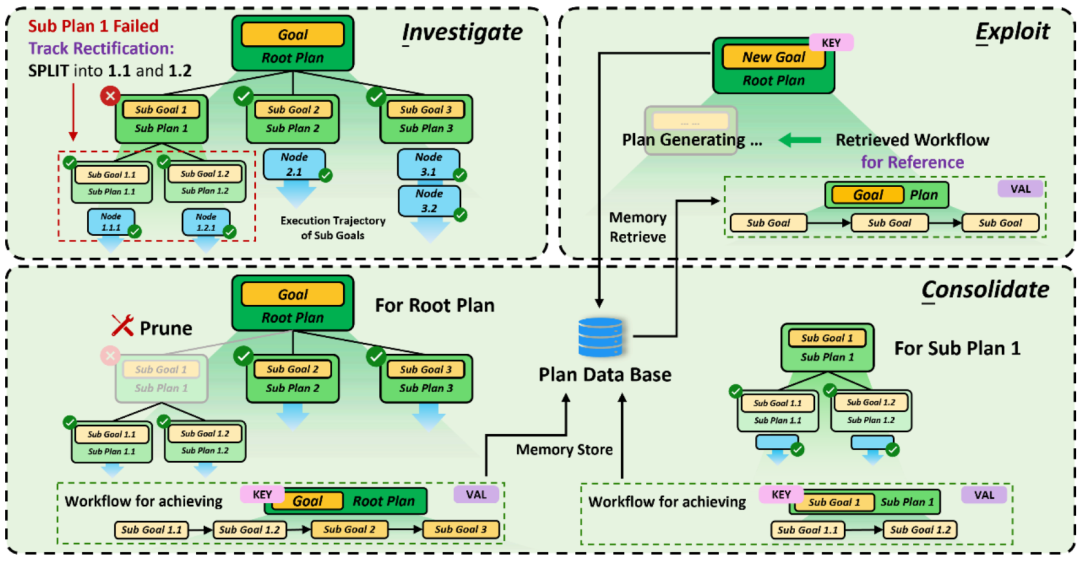

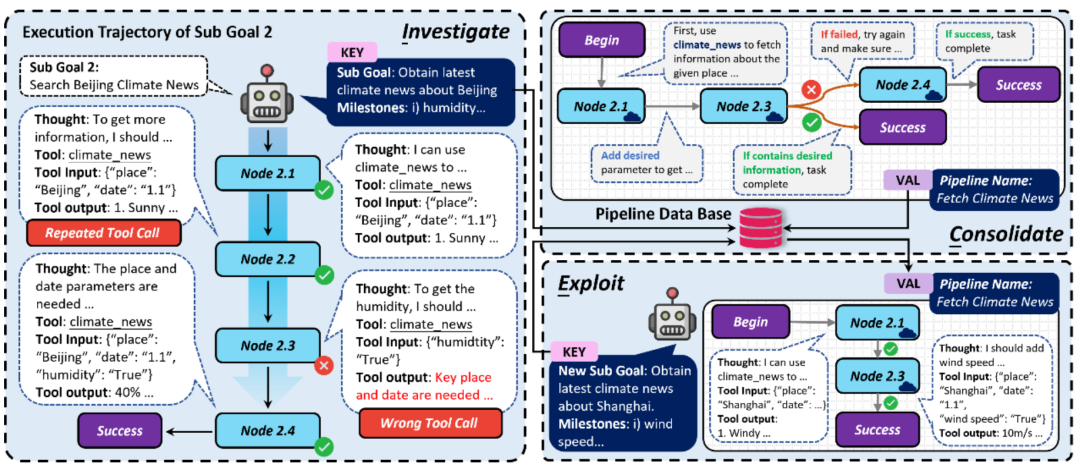

「以史为鉴,可以知兴替。」人类的进步史是一个不断吸取过去经验、推进能力边界的自我演化过程。我们从过去的失败中吸取教训,纠正错误;借鉴成功经验,提升效率和效果。这种自我进化贯穿生活方方面面:总结经验解决工作问题,利用规律预测天气,我们持续从过去学习和进化。 成功从过去的经验中提取知识并将其应用于未来的…

-

徒手搬螺丝,波士顿动力Atlas再进化:兄弟们,准备进厂了

在如今颇为火热的人形机器人赛道,波士顿动力是较早入局的一位选手。 在过去几年里,Atlas人形机器人的动态跑酷能力引起了全球的关注。随后,我们还看到Atlas在模拟建筑工地上展示了搬运能力。然而,需要指出的是,目前Atlas仍然只是一个开发平台,不能在现实世界中进行实际工作。其中一个原因是它使用的液…

-

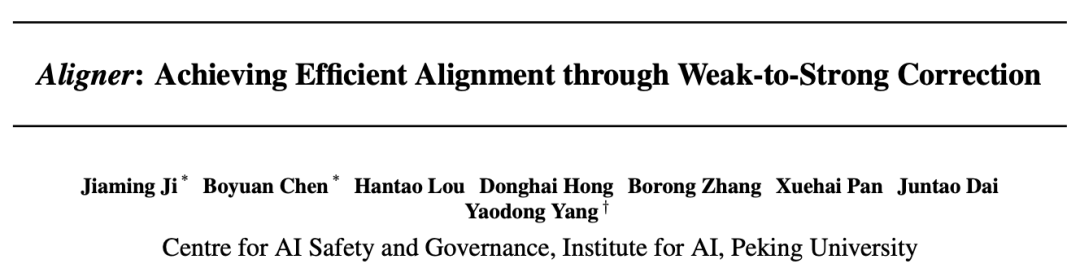

无需RLHF显著提升GPT-4/Llama2性能,北大团队提出Aligner对齐新范式

背景 大语言模型(LLMs)虽展现出了强大的能力,但也可能产生不可预测和有害的输出,例如冒犯性回应、虚假信息和泄露隐私数据,给用户和社会造成伤害。确保这些模型的行为与人类意图和价值观相对齐,是一个紧迫的挑战。 尽管基于人类反馈的强化学习(RLHF)提供了一种解决方案,但它面临复杂的训练架构、对参数的…

-

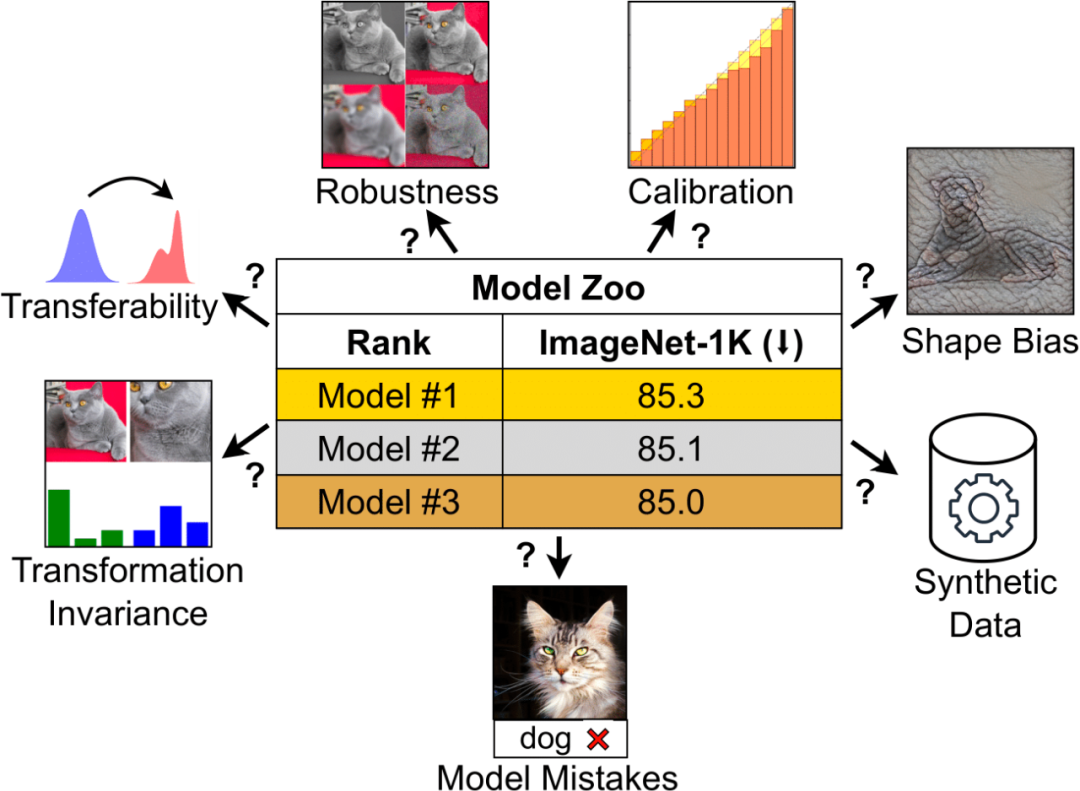

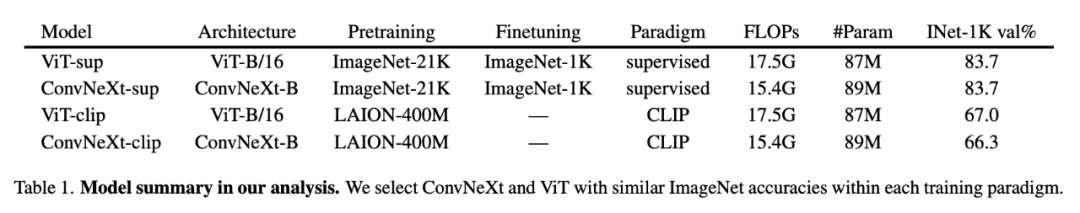

后Sora时代,CV从业者如何选择模型?卷积还是ViT,监督学习还是CLIP范式

ImageNet准确率曾是评估模型性能的主要指标,但在当今计算视觉领域,这一指标逐渐显得不够完善。 随着计算机视觉模型变得更加复杂,可用模型种类已显著增加,从ConvNets到Vision Transformers。训练方法也发展到自监督学习和像CLIP这样的图像-文本对训练,不再局限于ImageN…

-

田渊栋等人新作:突破内存瓶颈,让一块4090预训练7B大模型

meta fair 田渊栋参与的研究项目在上个月获得了广泛好评。在他们的论文《mobilellm: optimizing sub-billion parameter language models for on-device use cases》中,他们开始探讨如何优化10亿以下参数的小型模型,旨在…

-

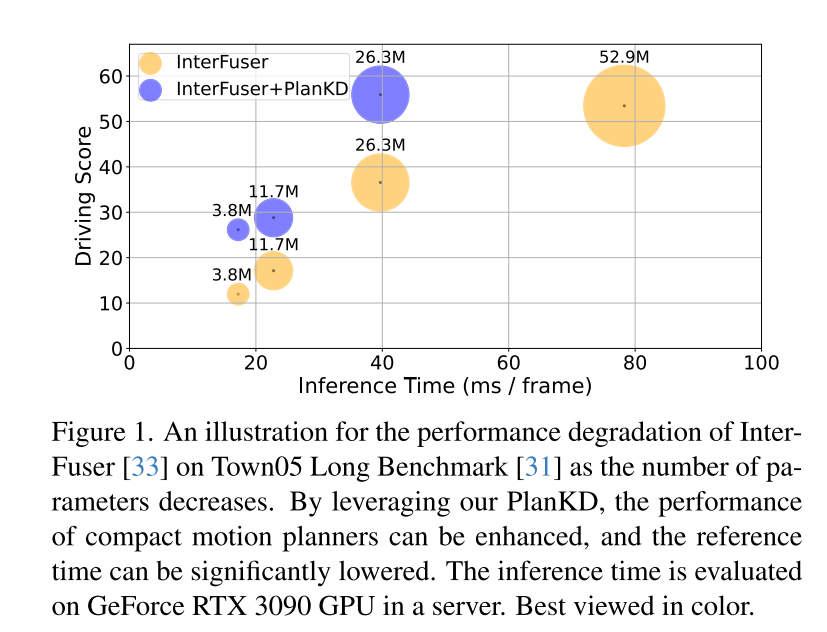

进一步加速落地:压缩自动驾驶端到端运动规划模型

原标题:on the road to portability: compressing end-to-end motion planner for autonomous driving 论文链接:https://arxiv.org/pdf/2403.01238.pdf 代码链接:https://gi…

-

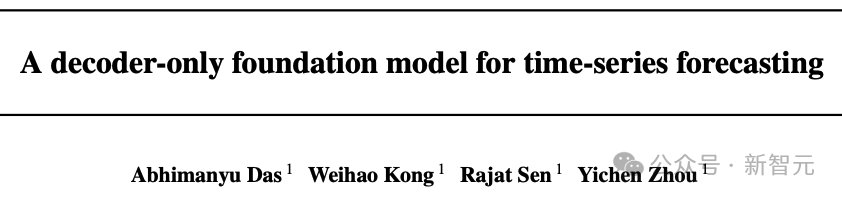

仅需200M参数,零样本性能超越有监督!谷歌发布时序预测基础模型TimesFM

时间序列预测在各个领域中起着重要作用,例如零售、金融、制造业、医疗保健和自然科学等。在零售行业中,通过提高需求预测的准确性,可以有效降低库存成本并增加收入。这意味着企业能够更好地满足客户需求,减少库存积压和损失,同时提高销售额和利润。因此,时间序列预测在零售领域中具有重要的价值,能够为企业带来实质 …

-

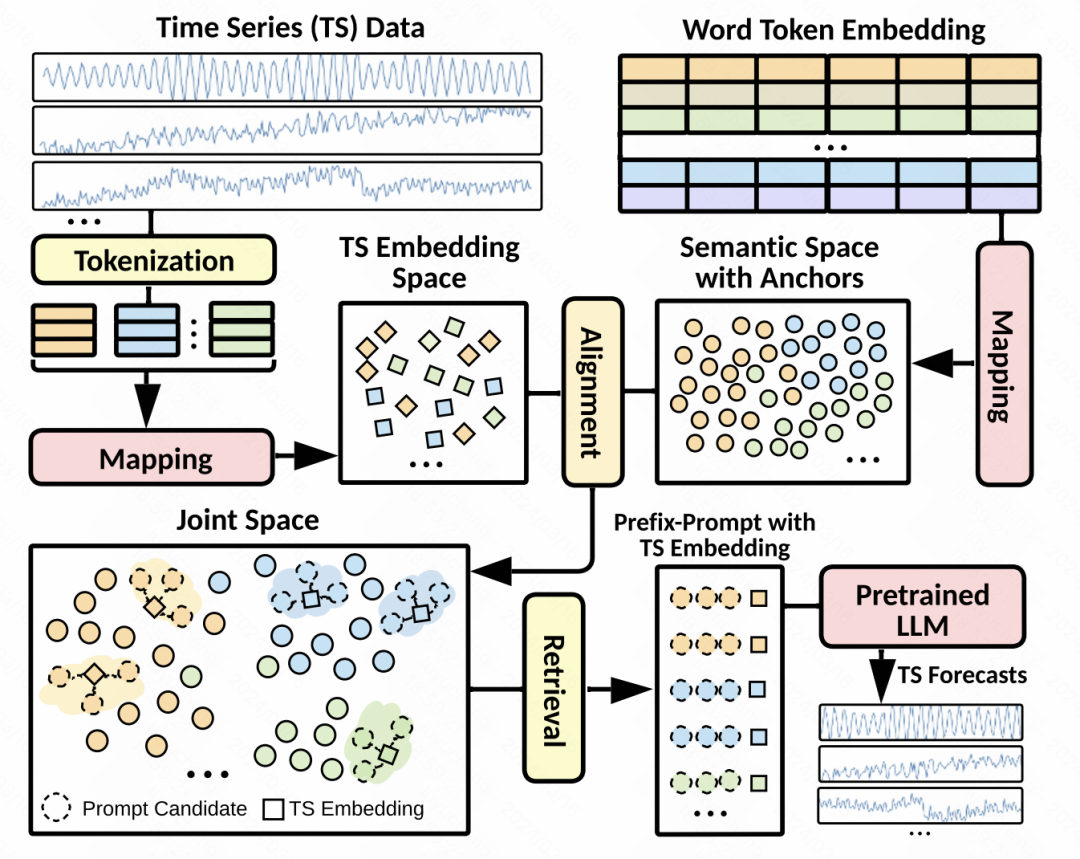

时间序列预测+NLP大模型新作:为时序预测自动生成隐式Prompt

今天我想分享一个最新的研究工作,这项研究来自康涅狄格大学,提出了一种将时间序列数据与自然语言处理(nlp)大模型在隐空间上对齐的方法,以提高时间序列预测的效果。这一方法的关键在于利用隐空间提示(prompt)来增强时间序列预测的准确性。 ☞☞☞AI 智能聊天, 问答助手, AI 智能搜索, 免费无限…

-

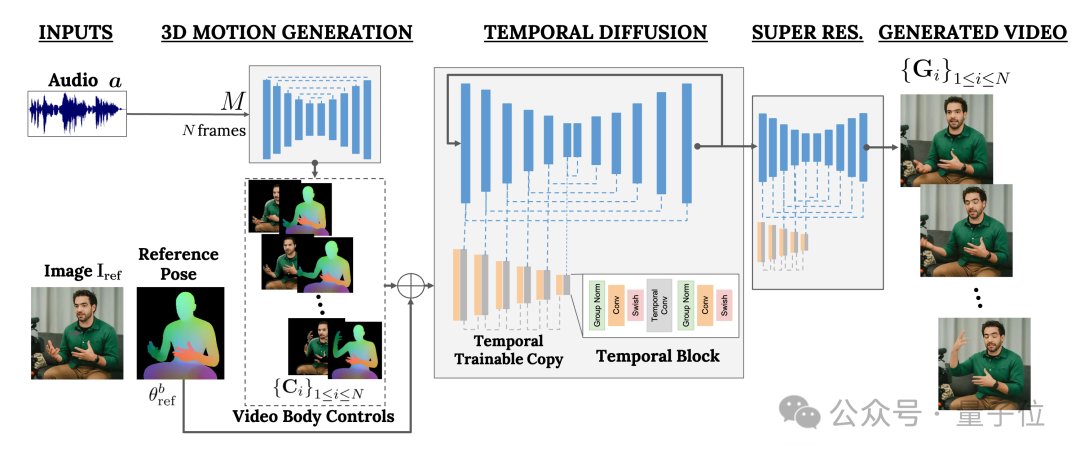

谷歌发布“Vlogger”模型:单张图片生成10秒视频

谷歌发布了一个新的视频框架: 只需要一张你的头像、一段讲话录音,就能得到一个本人栩栩如生的演讲视频。 视频时长可变,目前看到的示例最高为10s。 可以看到,无论是口型还是面部表情,它都非常自然。 如果输入图像囊括整个上半身,它也能配合丰富的手势: ☞☞☞AI 智能聊天, 问答助手, AI 智能搜索,…

-

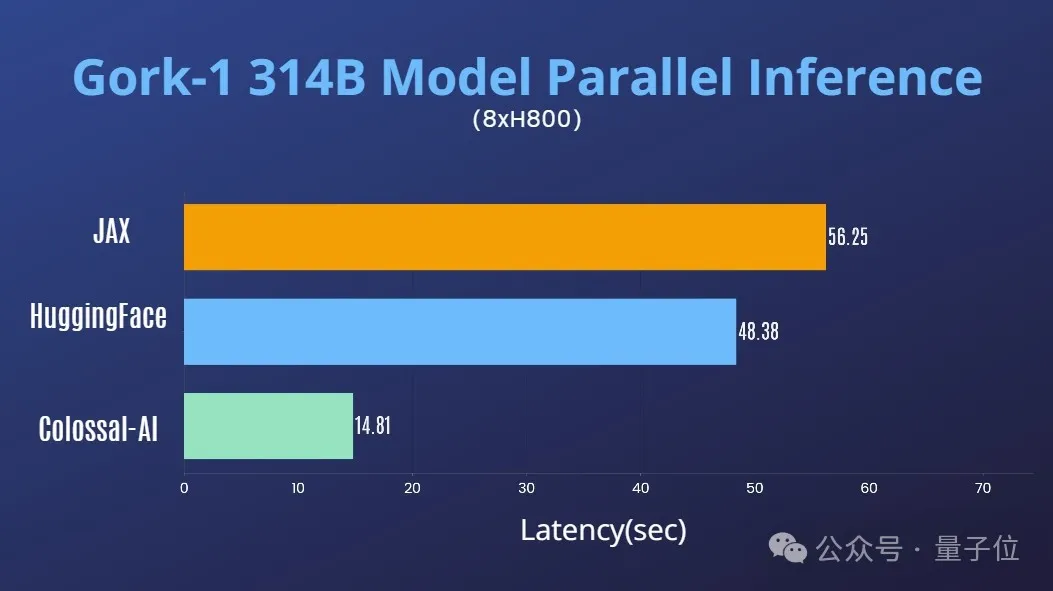

3140参数Grok-1推理加速3.8倍,PyTorch+HuggingFace版来了

马斯克说到做到开源grok-1,开源社区一片狂喜。 但基于Grok-1做改动or商用,都还有点难题: Grok-1使用Rust+JAX构建,对于习惯Python+PyTorch+HuggingFace等主流软件生态的用户上手门槛高。 ☞☞☞AI 智能聊天, 问答助手, AI 智能搜索, 免费无限量使…